Gemma 4 vs Llama 4 vs Qwen 3.5:2026 開源模型三巨頭完整比較

Gemma 4 vs Llama 4 vs Qwen 3.5:2026 開源模型三巨頭完整比較

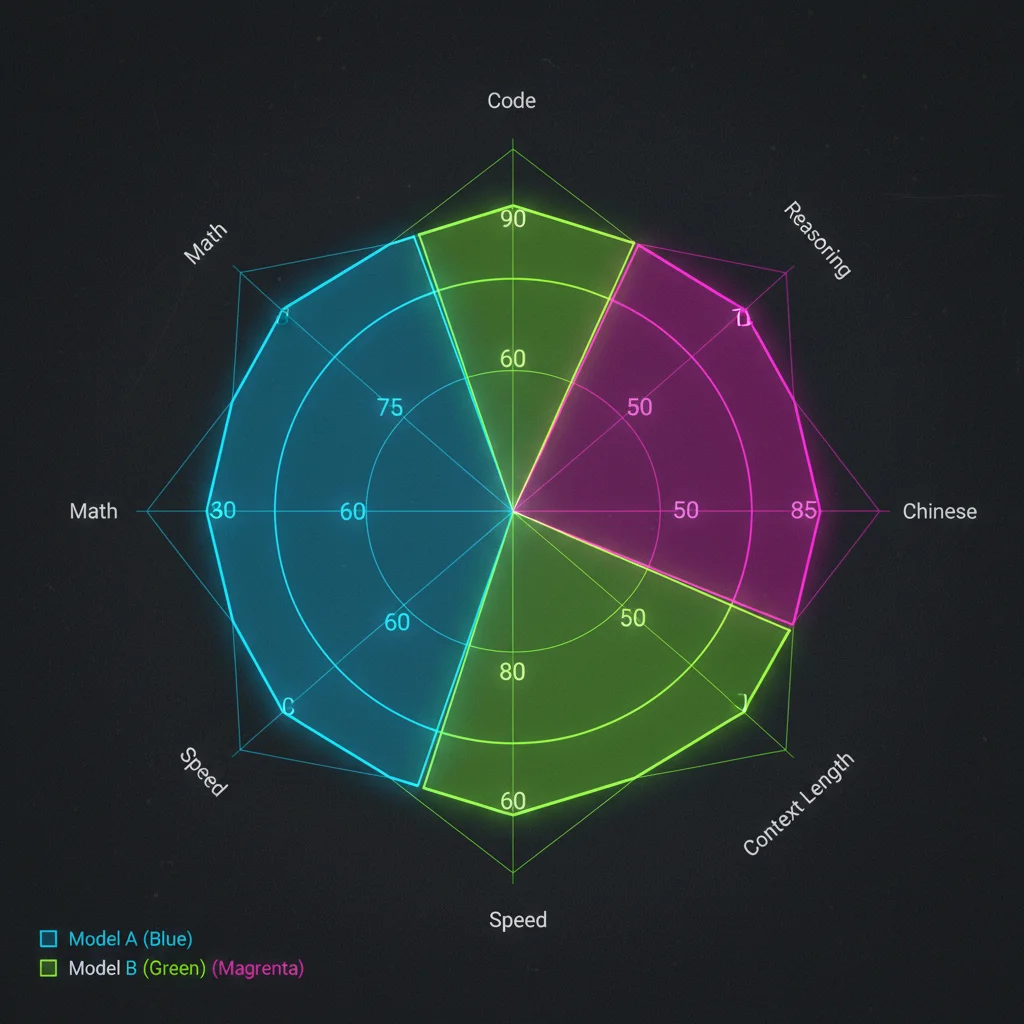

TL;DR: 2026 年開源模型三巨頭各有勝場。Gemma 4 在數學推理(AIME 89.2%)和 Apache 2.0 授權上領先;Qwen 3.5 在 MMLU Pro(86.1%)和中文能力上佔優;Llama 4 靠 10M token context window 獨佔長文本市場,但 700M MAU 授權限制是最大隱憂。選模型不看誰「最強」,看你的場景需要什麼。

你正在評估開源模型,面前擺著三個選項:Google 的 Gemma 4、Meta 的 Llama 4、阿里巴巴的 Qwen 3.5。三個都宣稱自己是 2026 年最好的開源模型。三個都有漂亮的 benchmark 數字。

但你只需要選一個。

這篇文章不會告訴你「哪個最好」——因為這個問題本身就是錯的。我會用實際的 benchmark 數據、推理速度測試、授權條款分析和中文能力比較,幫你找到最適合你場景的那一個。如果你還不熟悉 Gemma 4 的整體概況,建議先看 Gemma 4 完整指南。

正在評估哪個開源模型最適合你的產品?預約免費 AI 選型諮詢,讓我們根據你的實際需求給出建議。

2026 開源模型戰場:三巨頭各自的定位

三家公司做開源模型的動機完全不同,這直接影響了模型的設計取向。

Google(Gemma 4) 的策略是「生態系統入口」。Gemma 4 用 Apache 2.0 完全開放,目標是讓開發者用 Gemma 開發,最終導入 Google Cloud 和 Vertex AI。從 2.3B 到 31B 的完整尺寸覆蓋,確保從邊緣裝置到雲端伺服器都有 Gemma 的身影。

Meta(Llama 4) 的策略是「平台防禦」。Meta 需要確保 AI 技術不被少數公司壟斷,所以開源自家模型。但 Llama Community License 保留了 700M MAU 限制——翻譯成白話就是:你可以免費用,但不能用來跟我競爭。Llama 4 從 Scout(109B)到 Maverick(400B),走的是大模型路線。

阿里巴巴(Qwen 3.5) 的策略是「全球化突破」。Qwen 系列在中文能力上有天然優勢,加上 Apache 2.0 授權和原生多模態支援(包括視頻和音訊輸入),目標是成為亞洲市場的首選。從 0.8B 到 397B MoE 的超廣範圍,覆蓋面最大。

理解這些策略差異很重要。因為當你選模型時,你其實也在選擇加入哪個生態系統。

模型規格比較:參數量、Context Window、授權

先看硬規格。數字不會騙人。

全尺寸對照表

| 規格 | Gemma 4 31B | Llama 4 Scout | Qwen 3.5 27B |

|---|---|---|---|

| 總參數量 | 31B(Dense) | 109B(MoE) | 27B(Dense) |

| 活躍參數 | 31B | 17B | 27B |

| Context Window | 256K tokens | 10M tokens | 128K tokens |

| 授權 | Apache 2.0 | Llama Community License | Apache 2.0 |

| 多模態 | 文字 + 圖片 | 文字 + 圖片 | 文字 + 圖片 + 影片 + 音訊 |

| MoE 變體 | 26B A4B(3.8B 活躍) | Scout 本身即 MoE | 35B-A3B(3B 活躍) |

| 發布日期 | 2026 年 4 月 | 2025 年 4 月 | 2026 年 2 月 |

幾個值得注意的重點:

Context Window 差距巨大。 Llama 4 Scout 的 10M token context window 是其他兩家的 40-80 倍。如果你的應用需要處理超長文件(整本書、大型 codebase),Llama 4 在這個維度上完全沒有對手。

活躍參數的陷阱。 Llama 4 Scout 總參數 109B,但每次推理只啟動 17B。這意味著你需要載入 109B 的模型權重,卻只用到 17B 的計算量。VRAM 需求比你想像的高很多。

多模態能力差異。 Qwen 3.5 是目前唯一支援原生影片和音訊輸入的開源模型家族。如果你的應用涉及視頻理解或語音處理,Qwen 3.5 是現成的解決方案,其他兩家需要額外整合。

想深入了解 Gemma 4 的架構設計(MoE、Dual RoPE、256K context 的實現原理),可以看 Gemma 4 架構深度解析。

Benchmark 實測比較:誰在哪些任務最強

Benchmark 不是一切,但它是最客觀的起點。以下數據來自各模型官方技術報告和獨立評測平台。

核心 Benchmark 對照表

| Benchmark | Gemma 4 31B | Llama 4 Scout | Qwen 3.5 27B | 測什麼 |

|---|---|---|---|---|

| MMLU Pro | 85.2% | 74.3% | 86.1% | 綜合知識與推理 |

| AIME 2025 | 89.2% | 36.0% | 48.7% | 數學競賽推理 |

| GPQA Diamond | 84.3% | 65.2% | 85.5% | 研究所等級科學推理 |

| LiveCodeBench v6 | 80.0% | 53.4% | 72.4% | 程式碼生成 |

| Codeforces ELO | 2150 | — | 1850 | 競技程式設計 |

| Arena AI 排名 | #3(1441) | #12 | #6 | 人類偏好投票 |

解讀這些數字

Gemma 4 在數學和程式碼上碾壓。 AIME 89.2% vs Llama 4 的 36.0%——這不是「稍微好一點」,是完全不同的等級。如果你的應用核心是數學推理或程式碼生成,Gemma 4 是明確的首選。

Qwen 3.5 在通識推理上微幅領先。 MMLU Pro 86.1% 和 GPQA Diamond 85.5%,都比 Gemma 4 高出約 1 個百分點。在需要廣泛知識覆蓋的 chatbot 場景中,Qwen 3.5 可能更穩定。

Llama 4 Scout 的 benchmark 全面落後。 作為 2025 年 4 月發布的模型,與 2026 年初的競品比較顯然有些不公平。但如果你現在要做選擇,數字就是數字。Llama 4 的優勢不在 benchmark,在 context window。

我自己的觀察是:benchmark 數字和實際使用體驗之間有落差。Arena AI 的人類偏好排名(Gemma 4 #3、Qwen 3.5 #6)可能比任何單一 benchmark 更能反映真實世界的表現。

推理速度實測:同硬體誰跑最快

對開發者來說,推理速度直接影響使用者體驗和伺服器成本。

RTX 4090(24 GB VRAM)實測

| 模型 | 量化 | tok/s(生成) | 可否載入 | 備註 |

|---|---|---|---|---|

| Qwen 3.5 27B | Q4_K_M | ~35 | 可以 | 速度最快 |

| Gemma 4 31B | Q4_K_M | ~25 | 勉強(接近滿載) | 品質最高 |

| Gemma 4 26B MoE | Q4_K_M | ~11 | 可以 | MoE 路由開銷 |

| Llama 4 Scout | — | 無法載入 | 不行 | 109B 需要多卡 |

H100(80 GB VRAM)實測

| 模型 | 精度 | tok/s(生成) | 備註 |

|---|---|---|---|

| Qwen 3.5 27B | FP16 | ~95 | 企業級速度 |

| Gemma 4 31B | FP16 | ~75 | 品質/速度平衡好 |

| Gemma 4 26B MoE | FP16 | ~60 | 活躍參數少但路由開銷 |

| Llama 4 Scout | FP8 | ~45 | 勉強塞入單卡 |

幾個關鍵發現:

Qwen 3.5 27B 是速度王。 無論在消費級還是企業級硬體上,Qwen 3.5 27B 都是最快的。27B 的參數量配合良好的架構優化,讓它在 RTX 4090 上跑出 35 tok/s——對互動式應用來說非常流暢。

Gemma 4 MoE 的速度讓人意外。 理論上 MoE 只啟動 3.8B 參數應該很快,但實際上 MoE 路由的開銷加上需要載入全部 25.2B 權重,讓速度反而比 Dense 版慢。這在 vLLM 社群中是已知問題,未來版本的優化有望改善。

Llama 4 Scout 不適合單卡部署。 109B 總參數意味著 RTX 4090 根本裝不下,即使在 H100 上也需要 FP8 量化才能勉強塞入。如果你的預算只有消費級 GPU,Llama 4 直接出局。

想知道 Gemma 4 在各種硬體上的詳細表現?請參考 Gemma 4 硬體需求完整指南。

需要在有限預算內達到最佳推理效能?聯繫我們的 AI 基礎設施團隊,獲取客製化的硬體配置建議。

授權條款比較:Apache 2.0 vs Llama Community License

這是很多技術人員忽略,卻可能讓你的產品上線後陷入法律風險的部分。

三方授權對照表

| 條款 | Gemma 4(Apache 2.0) | Llama 4(Community License) | Qwen 3.5(Apache 2.0) |

|---|---|---|---|

| 商業使用 | 完全自由 | 有條件 | 完全自由 |

| MAU 限制 | 無 | 700M MAU 以上需申請 | 無 |

| 品牌標示 | 不需要 | 必須標示 "Built with Llama" | 不需要 |

| 修改 / 微調 | 完全自由 | 允許但受條款約束 | 完全自由 |

| 再發布 | 完全自由 | 必須附帶原始授權 | 完全自由 |

| 用於訓練其他模型 | 允許 | 禁止用於改進非 Llama 模型 | 允許 |

| 可接受使用政策 | 無 | 有(Meta 定義) | 無 |

為什麼授權條款比 benchmark 更重要

700M MAU 限制的真實影響。 你可能覺得 7 億月活離你很遠。但 Llama License 的計算方式是整個企業集團的 MAU,不是單一產品。如果你的公司旗下所有產品加起來超過 7 億 MAU,你用 Llama 4 就需要跟 Meta 談授權——而 Meta 可以「自行決定」是否同意。

「Built with Llama」標示要求。 如果你用 Llama 4 做產品,必須在網站、應用程式和文件中顯著標示。對白牌解決方案或 B2B 產品來說,這可能是個問題。

禁止用於訓練非 Llama 模型。 這條最容易被忽略。你不能用 Llama 4 的輸出來訓練、微調或改善其他模型家族。這對做模型蒸餾(distillation)的團隊是致命限制。

Apache 2.0 的優勢顯而易見。 Gemma 4 和 Qwen 3.5 都用 Apache 2.0,意味著你可以做任何事——商業使用、修改、再發布、用來訓練其他模型——完全沒有限制。對新創公司和企業來說,這消除了所有法律不確定性。

我的建議是:除非你有非常明確的理由(例如需要 10M token context),否則優先選 Apache 2.0 授權的模型。法律風險不值得冒。

中文能力比較:繁中/簡中誰表現最好

對台灣和大中華區的開發者來說,中文能力是選模型的關鍵因素之一。

中文能力排名

根據社群實測和公開 benchmark,中文能力排名如下:

第一名:Qwen 3.5 — 無懸念的冠軍。阿里巴巴的 Qwen 系列在中文訓練資料的質量和數量上有天然優勢。繁體中文和簡體中文都表現優異,成語、文言文、台灣用語的理解明顯優於其他兩家。

第二名:Gemma 4 — 進步巨大。Google 在 Gemma 4 的訓練資料中顯著增加了中文比例。繁中表現比 Gemma 3 好很多,但在複雜的中文語境(雙關語、文化典故)上仍不及 Qwen。

第三名:Llama 4 — 堪用但有差距。Meta 的中文訓練資料相對不足,在專業中文場景(法律文件、醫療報告)中偶有明顯錯誤。繁體中文的支援更是明顯弱於其他兩家。

實際中文測試對比

| 測試項目 | Gemma 4 31B | Llama 4 Scout | Qwen 3.5 27B |

|---|---|---|---|

| 繁中文章摘要 | 良好 | 普通 | 優秀 |

| 簡中技術文件翻譯 | 良好 | 良好 | 優秀 |

| 台灣口語理解 | 普通 | 差 | 良好 |

| 文言文翻譯 | 普通 | 差 | 良好 |

| 中文程式碼註解 | 良好 | 普通 | 良好 |

| 中文 RAG 問答 | 良好 | 普通 | 優秀 |

如果你的產品主要服務中文使用者,Qwen 3.5 是最安全的選擇。但如果中文只是附加需求而非核心功能,Gemma 4 的中文能力已經足夠好。

需要為你的中文 AI 產品選擇最適合的模型?預約免費諮詢,我們有豐富的中文模型部署經驗。

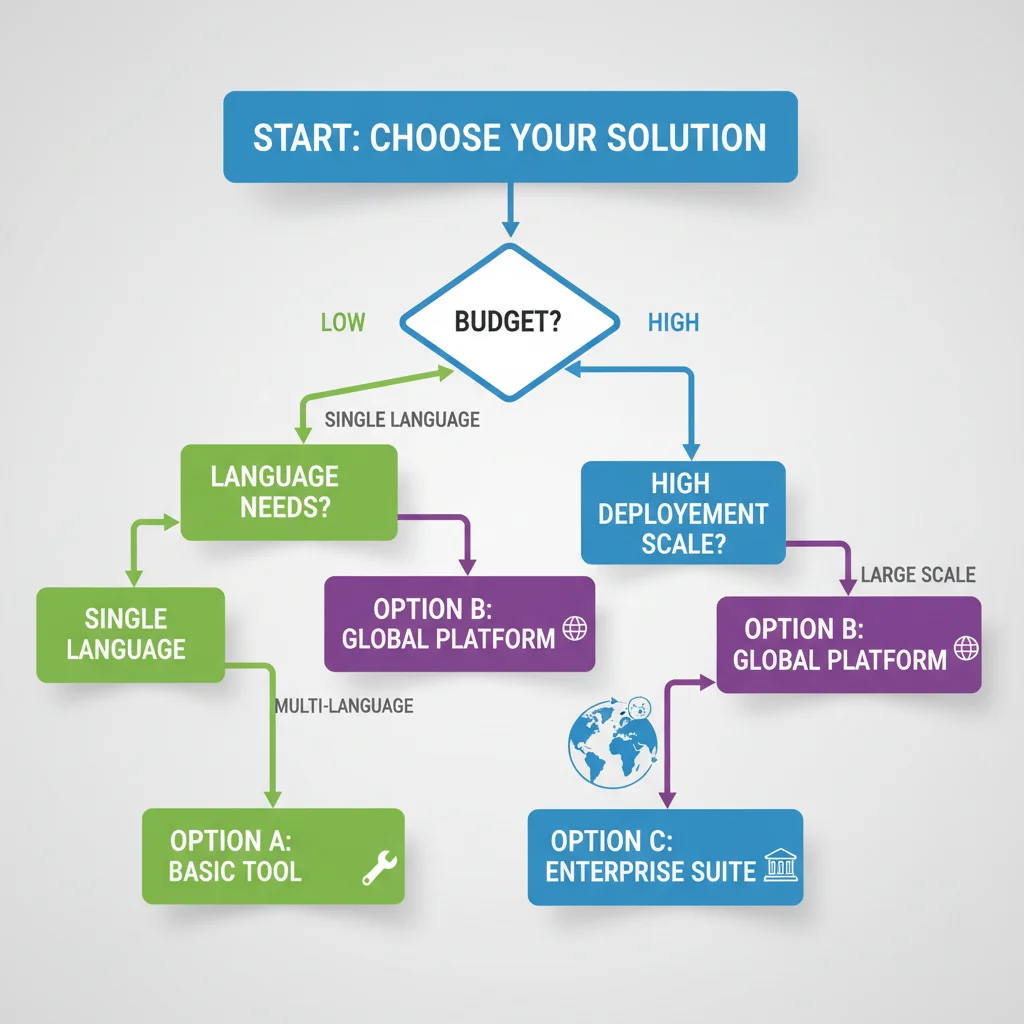

選型決策指南:什麼場景選哪個

理論分析完了,來做決策。以下是根據不同場景的具體推薦。

決策樹:5 個問題幫你選模型

問題 1:你的應用需要處理超長文本(> 256K tokens)嗎?

- 是 → Llama 4 Scout(10M token context window 無可取代)

- 否 → 繼續

問題 2:中文能力是核心需求嗎?

- 是 → Qwen 3.5 27B(中文能力最強,Apache 2.0 無憂)

- 否 → 繼續

問題 3:你的硬體預算只有消費級 GPU(RTX 4090 或以下)?

- 是 → Llama 4 Scout 出局,選 Gemma 4 31B 或 Qwen 3.5 27B

- 否 → 繼續

問題 4:你的應用核心是數學推理或程式碼生成?

- 是 → Gemma 4 31B(AIME 89.2%,LiveCodeBench 80.0%)

- 否 → 繼續

問題 5:你需要最大的推理吞吐量?

- 是 → Qwen 3.5 27B(RTX 4090 上 35 tok/s 最快)

- 否 → Gemma 4 31B(綜合最均衡,Apache 2.0 授權)

場景推薦總表

| 場景 | 推薦模型 | 原因 |

|---|---|---|

| 中文客服 chatbot | Qwen 3.5 27B | 中文能力最強 + 推理速度快 |

| 程式碼助手 | Gemma 4 31B | LiveCodeBench 和 Codeforces 領先 |

| 法律文件分析(超長文本) | Llama 4 Scout | 10M context window |

| 邊緣裝置部署 | Gemma 4 E2B(2.3B) | 尺寸最小,Apache 2.0 |

| 多模態應用(含影片) | Qwen 3.5 | 唯一原生支援影片輸入 |

| 新創公司 MVP | Gemma 4 31B | 品質/速度/授權最均衡 |

| 模型蒸餾 / 訓練 | Gemma 4 或 Qwen 3.5 | Apache 2.0,可自由用於訓練 |

| 企業大規模部署 | 依場景而定 | 見企業部署指南 |

想了解如何在本地實際部署 Gemma 4?請參考 Gemma 4 本地部署完整教學。也可以看看其他 AI API 的比較:Gemini vs OpenAI API 比較。

團隊正在做模型選型,想要更客製化的建議?預約 AI 技術顧問,我們能根據你的具體需求、預算和技術棧給出推薦。

常見問題(FAQ)

Gemma 4 和 Qwen 3.5 都是 Apache 2.0,除了 benchmark 還有什麼差異?

最大的差異在生態系統和工具鏈。Gemma 4 與 Google Cloud、Vertex AI、Android / Chrome 的整合最深;Qwen 3.5 在阿里雲生態系統中有最好的支援,並且是唯一原生支援影片和音訊輸入的開源模型。另外,Gemma 4 的小模型(E2B 2.3B)在邊緣部署上比 Qwen 3.5 的最小模型(0.8B)品質更好,但 Qwen 0.8B 更小。

Llama 4 的 700M MAU 限制真的會影響到我嗎?

如果你是新創公司或中小企業,短期內不會。但要注意兩點:(1)MAU 計算包含你整個企業集團的所有產品,不只是用 Llama 的那個產品;(2)如果你的產品被大公司收購,收購方的 MAU 也會被計入。選 Apache 2.0 的模型可以完全避免這個風險。

我可以把三個模型混合使用嗎?

可以,而且這是很多團隊的做法。例如:用 Gemma 4 處理數學和程式碼任務、用 Qwen 3.5 處理中文相關任務、用 Llama 4 處理需要超長 context 的任務。但注意 Llama 4 的授權禁止你用它的輸出來訓練非 Llama 模型,所以混合使用時要小心資料流向。

2026 下半年這些模型會怎麼發展?

Google 已經暗示 Gemma 4 Ultra(更大的 Dense 模型)可能在 Q3 發布。Meta 的 Llama 5 預計在年底前出現。阿里巴巴的 Qwen 4 時程不明,但以他們的發布節奏推測,可能在 2026 Q4。建議選模型時不要賭未來——用現在最適合你的。

還有其他技術問題?直接聯繫我們的 AI 團隊,免費獲取專業建議。

相關文章

Gemma 4 企業導入指南:選型策略、成本分析與部署建議

2026 年企業如何導入 Gemma 4 開源模型?完整指南涵蓋四款模型的適用場景、雲端 vs 本地部署成本試算(Vertex AI vs 自建 GPU)、企業部署架構、資料安全合規考量,以及從 PoC 到正式上線的四階段路線圖。

AI 開發工具Gemma 4 微調教學:LoRA/QLoRA 實戰,消費級 GPU 也能跑

2026 年 Gemma 4 微調完整教學:LoRA vs QLoRA vs Full Fine-tuning 比較、Unsloth 環境設定、資料準備格式、手把手訓練流程、評估方法與模型部署。RTX 4090 單卡即可完成微調。

AI 開發工具Gemma 4 完整指南:2026 年最強開源模型從入門到實戰

2026 年 Google 發布 Gemma 4 開源模型,Apache 2.0 授權、四種尺寸(E2B 到 31B)、256K context window、多模態支援。完整解析架構、部署、微調、API 串接與企業導入策略。