Gemma 4 本地部署教學:Ollama、LM Studio、Unsloth 三種方式完整攻略

Gemma 4 本地部署教學:Ollama、LM Studio、Unsloth 三種方式完整攻略

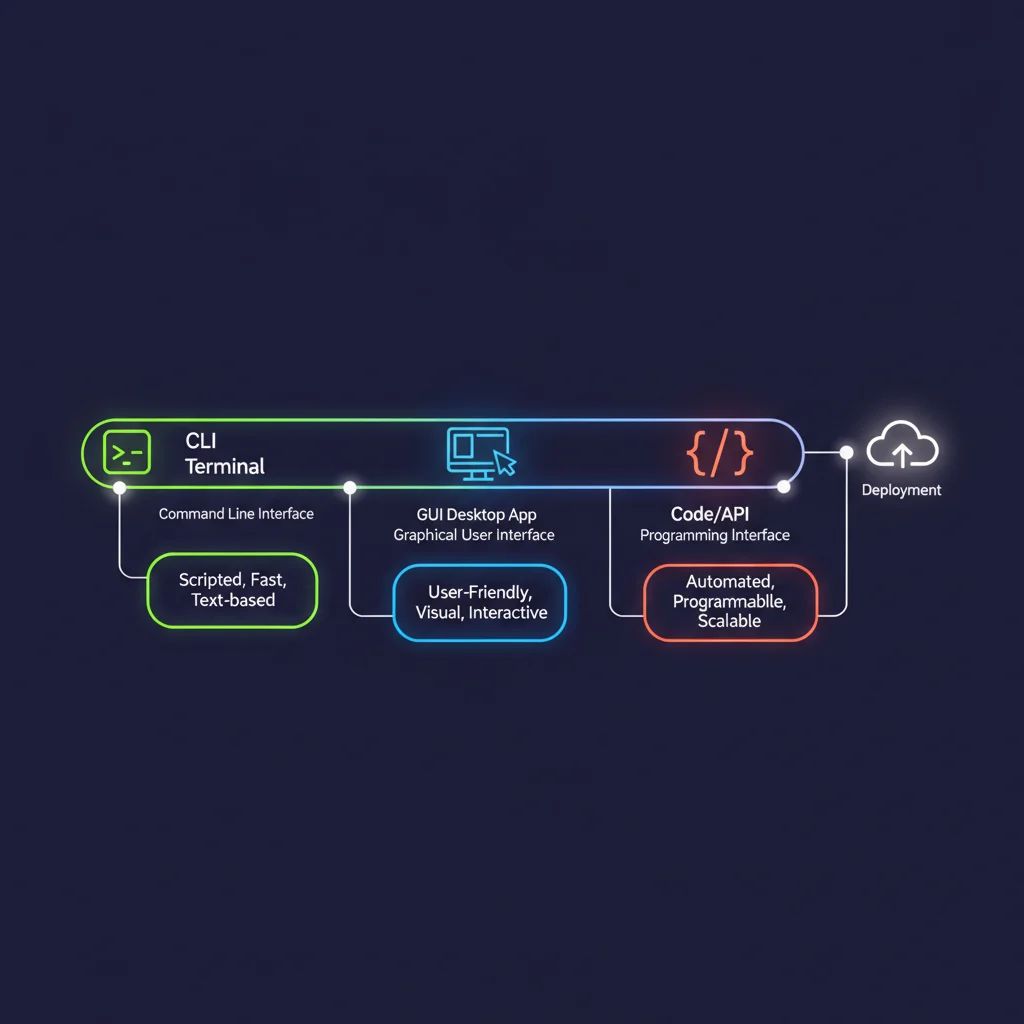

TL;DR: Ollama 一行指令五分鐘跑起來,適合開發者快速驗證;LM Studio 有圖形介面,適合不想碰終端機的使用者;Unsloth 記憶體效率最高,還能無縫接上微調流程。三種方式都支援 Gemma 4 全系列模型,選哪個取決於你的使用場景。

「裝個 Ollama 就好了吧?」這是我聽到最多的回答。但實際上,Ollama 只是三種主流方案之一,而且不一定是最適合你的那個。

我在過去一週用三種方式分別部署了 Gemma 4 的 E4B 和 26B 版本,踩了不少坑,也發現了一些官方文件沒提到的細節。這篇文章把三種方式的完整流程、優缺點和常見問題一次講清楚。

不確定哪種部署方式最適合你的團隊?預約免費架構諮詢,讓我們的顧問根據你的硬體和需求推薦最佳方案。

想先了解 Gemma 4 的完整功能和模型家族?請參考 Gemma 4 完整指南。

為什麼要在本地跑 Gemma 4?三個理由

在開始動手之前,先想清楚一件事:你真的需要本地部署嗎?

如果你只是偶爾用一下,Google AI Studio 或 Vertex AI 的 API 可能更省事。但如果你符合以下任何一個情境,本地部署就是正確的選擇。

理由一:資料隱私與合規

醫療、金融、法律——這些產業的資料不能離開公司網路。本地部署意味著你的 prompt 和回應永遠不會經過第三方伺服器。GDPR、HIPAA、個資法,全部自動合規。

理由二:離線可用

飛機上、偏遠工地、網路不穩的工廠。本地部署讓你在完全離線的環境下也能用 AI。我有個客戶在離岸風電平台上用 Gemma 4 E4B 做設備檢測報告,完全不需要網路。

理由三:零 API 成本

API 按 token 計費,量一大就很嚇人。本地部署的邊際成本幾乎是零——硬體是一次性投資,電費可以忽略不計。如果你每天要處理幾十萬 token 的推理量,本地部署三個月就能回本。

部署前準備:確認你的硬體能跑哪個版本

動手之前,先確認你的硬體。選錯模型版本,輕則跑得像蝸牛,重則直接 OOM crash。

快速對照:

| 模型 | 4-bit VRAM 需求 | 推薦最低硬體 |

|---|---|---|

| E2B (2.3B) | ~1.5 GB | 手機、Raspberry Pi |

| E4B (4.3B) | ~3 GB | 8GB RAM 筆電 |

| 26B MoE (A4B) | ~16 GB | RTX 4060 Ti 16GB / M3 24GB |

| 31B Dense | ~18 GB | RTX 4090 24GB / M4 Pro 48GB |

不確定自己該選哪個版本?完整的硬體需求分析請看 Gemma 4 硬體需求完整對照,裡面有每款 GPU 和 Apple Silicon 的實測速度。

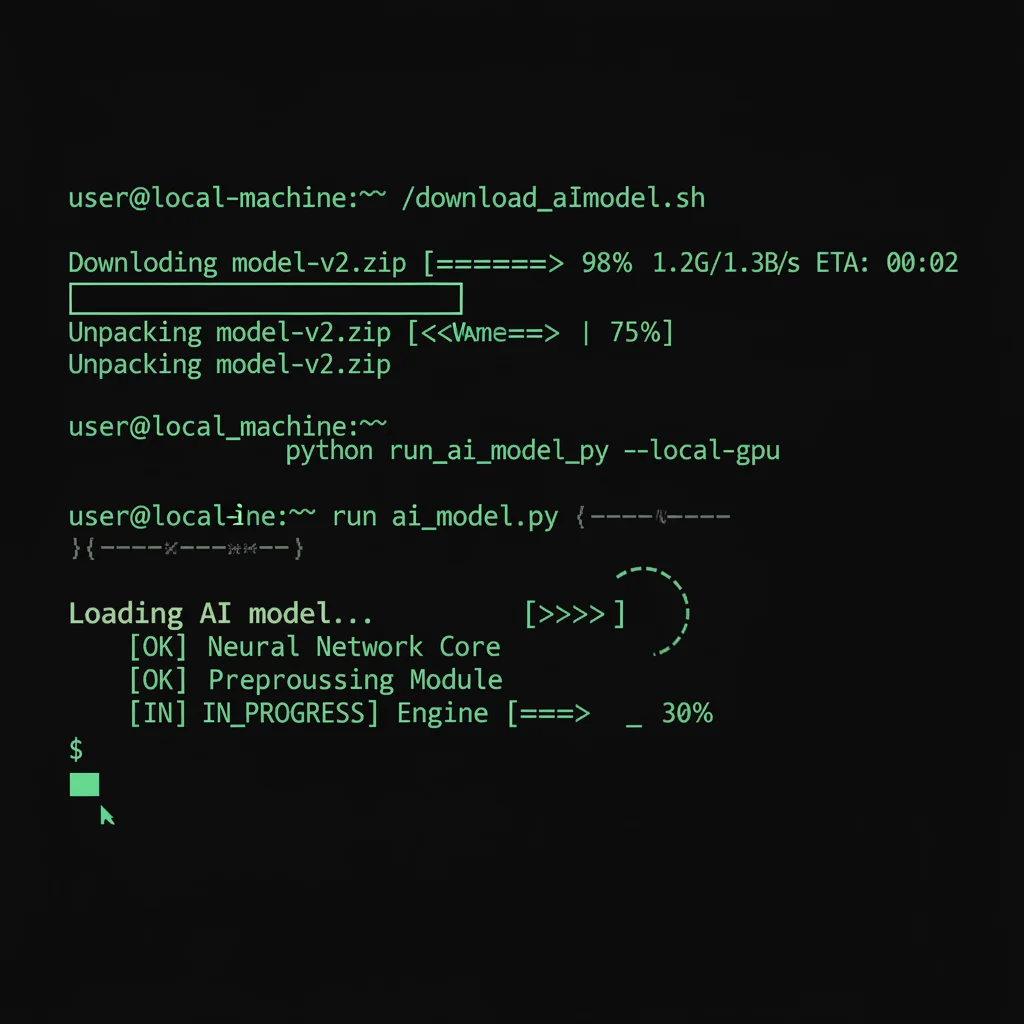

方法一:用 Ollama 五分鐘跑起來

Ollama 是目前最簡單的本地 LLM 部署工具,沒有之一。一行指令安裝,一行指令下載模型,一行指令開始對話。如果你是開發者,這是我最推薦的起步方式。

步驟一:安裝 Ollama

macOS:

# 方法一:直接下載

curl -fsSL https://ollama.com/install.sh | sh

# 方法二:用 Homebrew

brew install ollama

Linux:

curl -fsSL https://ollama.com/install.sh | sh

Windows:

到 ollama.com 下載 .exe 安裝檔,雙擊執行即可。

安裝完成後,Ollama 會自動啟動背景服務,預設監聽 localhost:11434。

步驟二:下載 Gemma 4 模型

# 推薦入門版本:E4B(約 3GB)

ollama pull gemma4:e4b

# 想要更強的推理能力:26B MoE(約 16GB)

ollama pull gemma4:26b

# 最輕量版本:E2B(約 1.5GB)

ollama pull gemma4:e2b

下載時間取決於你的網速。E4B 大約 3GB,100Mbps 的網路約 4 分鐘。26B 的 Q4 版本約 16GB,需要更長時間。

步驟三:開始對話

# 直接跑,進入互動式對話

ollama run gemma4:e4b

# 帶 thinking 模式(Gemma 4 支援可配置思考)

ollama run gemma4:e4b --verbose

你會看到一個互動式的聊天介面。輸入問題,模型就會回答。按 Ctrl+D 退出。

步驟四:用 API 串接你的應用

Ollama 內建 OpenAI 相容的 API server,你的程式碼幾乎不用改:

# 測試 API

curl http://localhost:11434/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "gemma4:e4b",

"messages": [{"role": "user", "content": "用三句話解釋量子電腦"}]

}'

# Python 範例(用 openai 套件)

from openai import OpenAI

client = OpenAI(base_url="http://localhost:11434/v1", api_key="ollama")

response = client.chat.completions.create(

model="gemma4:e4b",

messages=[{"role": "user", "content": "用三句話解釋量子電腦"}]

)

print(response.choices[0].message.content)

量化版本選擇

Ollama 預設下載的是 Q4_K_M 量化版本,這對大多數場景來說已經夠用。如果你想要更高品質:

# 指定量化版本

ollama pull gemma4:26b-q8_0 # 8-bit,品質更好但需要更多 VRAM

ollama pull gemma4:e4b-fp16 # 完整精度,需要 8.6GB VRAM

Ollama 的優點: 安裝最簡單、社群最大、API 相容性好、模型庫豐富。 Ollama 的缺點: 沒有 GUI、進階設定需要寫 Modelfile、不支援微調。

想把 Ollama 整合進你的產品?預約技術諮詢,我們有豐富的本地 LLM 整合經驗。

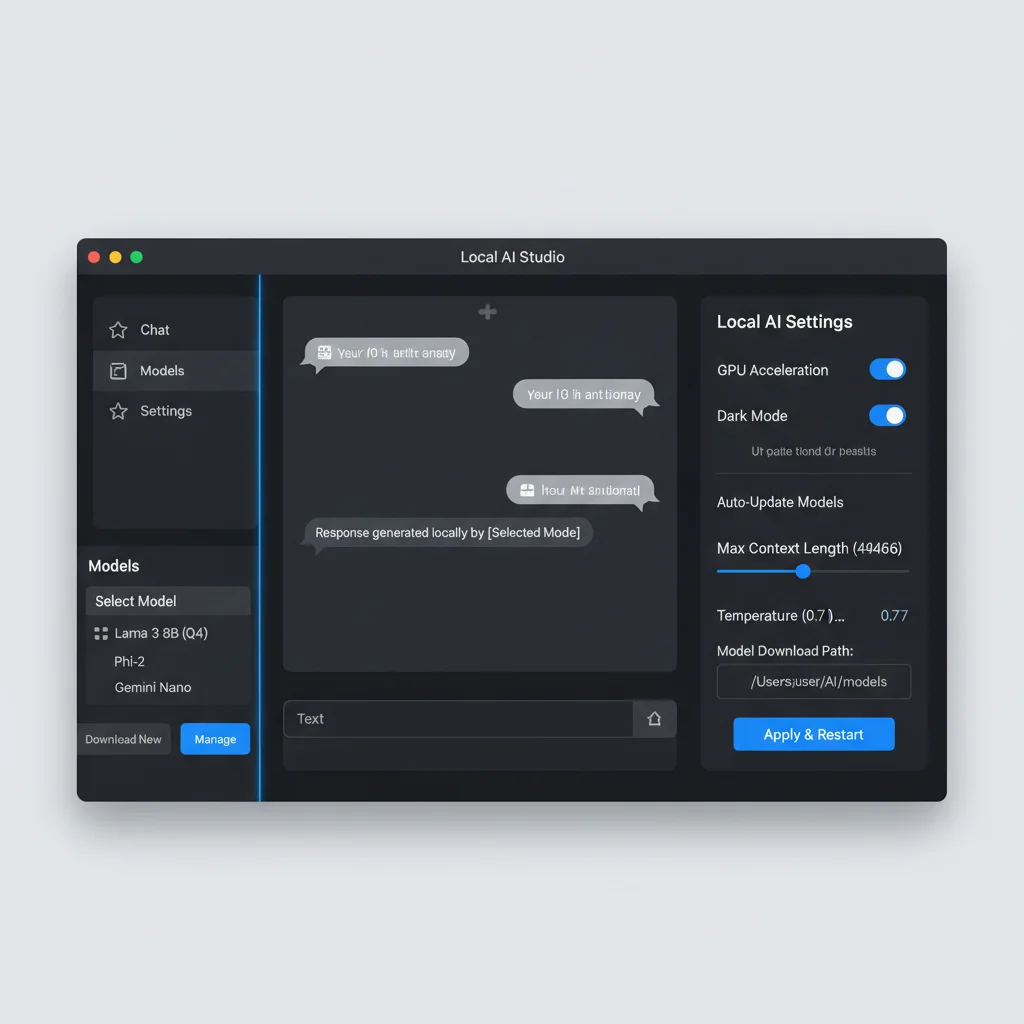

方法二:用 LM Studio 圖形化介面零門檻上手

不是每個人都喜歡在終端機裡打指令。如果你是 PM、設計師、或只是想快速體驗 Gemma 4 的非技術人員,LM Studio 是最好的選擇。

LM Studio 在 Gemma 4 發布當天就提供了支援,包括最新的 0.4.0 版本還引入了 lms CLI 和 llmster,讓進階使用者也能用命令列操作。

步驟一:下載安裝 LM Studio

到 lmstudio.ai 下載對應你作業系統的安裝檔。支援 macOS、Windows 和 Linux。

安裝過程跟裝一般桌面應用一樣——下一步、下一步、完成。

步驟二:搜尋並下載 Gemma 4 模型

- 打開 LM Studio

- 點左側的「Discover」標籤

- 搜尋欄輸入

gemma-4 - 你會看到 Unsloth 提供的各種量化版本(GGUF 格式)

- 根據你的記憶體選擇合適的版本,點「Download」

推薦選擇:

- 8GB RAM 機器 →

gemma-4-E4B-it-GGUF(Q4_K_M) - 16GB+ RAM 機器 →

gemma-4-26B-A4B-it-GGUF(Q4_K_M)

步驟三:載入模型並設定參數

- 點左側的「Chat」標籤

- 上方的模型選擇器中選擇你剛下載的模型

- 右側面板可以調整參數:

- Context Length:預設 4096,Gemma 4 小模型支援到 128K

- Temperature:創意任務調高(0.7-1.0),精確任務調低(0.1-0.3)

- GPU Offload:有獨顯的話拉到最大值,把運算全丟給 GPU

步驟四:開始對話

直接在聊天框輸入問題就行。LM Studio 還支援:

- 多模態輸入:直接拖圖片進聊天框,Gemma 4 全系列都支援圖片理解

- System Prompt:在設定面板中定義模型的角色和行為

- 對話紀錄:自動儲存,下次打開可以繼續

進階:用 LM Studio 當 API Server

LM Studio 也能當本地 API server,跟 Ollama 一樣提供 OpenAI 相容介面:

- 點左側的「Developer」標籤

- 選擇模型,點「Start Server」

- 預設地址是

http://localhost:1234/v1

curl http://localhost:1234/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "gemma-4-e4b-it",

"messages": [{"role": "user", "content": "Hello!"}]

}'

LM Studio 的優點: 圖形化操作零門檻、模型瀏覽器方便搜尋和下載、支援多模態、可當 API server。 LM Studio 的缺點: 佔用系統資源比 Ollama 多(Electron 應用)、不支援微調、進階用戶可能覺得 GUI 多此一舉。

方法三:用 Unsloth 跑推理 + 準備微調環境

如果你的目標不只是「跑起來」,而是要做微調、量化、或在記憶體受限的環境下榨出最高效能,Unsloth 是正確的選擇。

Unsloth 在 Gemma 4 發布當天就提供了完整支援,包括預量化的 GGUF 和 MLX 格式模型。它的 MLX 版本在 Apple Silicon 上比 Ollama 節省約 40% 的記憶體,代價是推理速度慢 15-20%。

步驟一:安裝 Unsloth

# 建立虛擬環境(推薦)

python3 -m venv unsloth-env

source unsloth-env/bin/activate

# 安裝 Unsloth

pip install unsloth

如果你用 NVIDIA GPU,確保已安裝 CUDA toolkit。Unsloth 支援 CUDA 11.8+。

步驟二:用 Unsloth 跑推理

from unsloth import FastLanguageModel

# 載入模型(自動偵測最佳量化設定)

model, tokenizer = FastLanguageModel.from_pretrained(

model_name="unsloth/gemma-4-E4B-it",

max_seq_length=4096,

load_in_4bit=True, # 4-bit 量化

)

# 啟用推理模式

FastLanguageModel.for_inference(model)

# 準備輸入

messages = [{"role": "user", "content": "解釋 LoRA 微調的原理"}]

inputs = tokenizer.apply_chat_template(

messages, tokenize=True, add_generation_prompt=True, return_tensors="pt"

).to("cuda")

# 生成回應

outputs = model.generate(input_ids=inputs, max_new_tokens=512)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))

步驟三:用 vLLM 做生產級推理

如果你要服務多個使用者,vLLM 的批次推理效能遠超單純的 Transformers 推理:

# 安裝 vLLM

pip install vllm

# 啟動 vLLM server

vllm serve unsloth/gemma-4-26B-A4B-it-GGUF \

--quantization awq \

--max-model-len 8192 \

--gpu-memory-utilization 0.9

vLLM 的 continuous batching 和 PagedAttention 在處理多個同時請求時,吞吐量比簡單的推理方式高出 3-5 倍。

步驟四:從推理無縫轉微調

Unsloth 最大的優勢就在這裡——同一個框架,從推理到微調不需要切換工具:

from unsloth import FastLanguageModel

import torch

# 載入模型並準備 LoRA 微調

model, tokenizer = FastLanguageModel.from_pretrained(

model_name="unsloth/gemma-4-E4B-it",

max_seq_length=2048,

load_in_4bit=True,

)

# 加上 LoRA adapter

model = FastLanguageModel.get_peft_model(

model,

r=16,

lora_alpha=16,

target_modules=["q_proj", "k_proj", "v_proj", "o_proj"],

)

# 接下來就可以開始訓練...

完整的微調教學請參考 Gemma 4 微調指南。

Unsloth 的優點: 記憶體效率最高、支援推理到微調的完整流程、MLX 優化讓 Mac 效能更好、社群活躍。 Unsloth 的缺點: 需要 Python 環境、設定比較複雜、不適合非技術使用者。

需要在生產環境部署 Gemma 4?聯繫我們的架構團隊,從推理伺服器到微調 pipeline 一站搞定。

三種方式怎麼選?決策比較表

| 比較項目 | Ollama | LM Studio | Unsloth |

|---|---|---|---|

| 上手難度 | 低(一行指令) | 最低(圖形化) | 中高(需 Python) |

| 安裝時間 | 2 分鐘 | 3 分鐘 | 10-15 分鐘 |

| 記憶體效率 | 中 | 中 | 高(省 ~40%) |

| 推理速度 | 快 | 快 | 中(MLX 慢 15-20%) |

| API 相容 | OpenAI 相容 | OpenAI 相容 | 需搭配 vLLM |

| GUI 介面 | 無 | 有 | 無 |

| 微調支援 | 不支援 | 不支援 | 原生支援 |

| 多模態 | 支援 | 支援(拖放圖片) | 支援 |

| 適合對象 | 開發者、CLI 愛好者 | 非技術人員、快速體驗 | ML 工程師、需要微調 |

我的建議:

- 「我只想快速試一下」 → LM Studio。下載、安裝、搜尋模型、開始聊天。五分鐘,不需要打任何指令。

- 「我要整合到我的應用裡」 → Ollama。API 最穩定、社群資源最多、Docker 部署也方便。

- 「我要微調或記憶體很吃緊」 → Unsloth。省 40% 記憶體不是開玩笑的,而且微調流程一條龍。

本地部署常見問題排除

OOM(Out of Memory)錯誤

這是最常見的問題。症狀通常是模型載入到一半就 crash,或推理到一半被 kill。

解法:

- 換更小的量化版本:從 Q8 換到 Q4_K_M,或從 Q4 換到 Q3_K_S

- 降低 context length:把 context window 從 128K 降到 8K 或 4K

- 關閉其他吃記憶體的程式:Chrome 是最大的兇手

- 增加 swap space:Linux 上可以暫時增加 swap,雖然會變慢但至少能跑

# 查看當前記憶體使用

nvidia-smi # NVIDIA GPU

# 或

ollama ps # 看 Ollama 載入了哪些模型

推理速度太慢

如果模型能跑但速度不理想(低於 10 tok/s),試試以下方法:

- 確認 GPU 有被使用:

nvidia-smi查看 GPU utilization,如果是 0% 代表模型跑在 CPU 上 - 在 Ollama 中增加 GPU layers:建立 Modelfile 設定

num_gpu參數 - 用更激進的量化:Q4_K_S 比 Q4_K_M 快約 10-15%

- Mac 使用者用 MLX 版本:比 llama.cpp 後端快 30-50%

模型下載失敗或中斷

# Ollama:重新下載會自動續傳

ollama pull gemma4:26b

# 手動下載 GGUF(適用 LM Studio 或手動部署)

# 從 Hugging Face 下載

huggingface-cli download unsloth/gemma-4-26B-A4B-it-GGUF \

--include "gemma-4-26B-A4B-it-Q4_K_M.gguf"

如果 Hugging Face 下載速度太慢,可以用 hf_transfer 加速:

pip install hf_transfer

HF_HUB_ENABLE_HF_TRANSFER=1 huggingface-cli download ...

模型輸出亂碼或品質異常

通常是量化版本的問題。Q2、Q3 的低位元量化在某些任務上品質下降明顯。解法是換 Q4_K_M 以上的版本,或者加上 system prompt 來穩定輸出格式。

部署過程遇到搞不定的問題?聯繫我們的技術支援,我們提供本地 AI 部署的全流程技術支援。

常見問題

Ollama 和 LM Studio 可以同時跑嗎?

可以,但不建議同時載入模型。兩個工具會各自佔用 VRAM,容易 OOM。如果你要同時用,確保一個工具的模型已經 unload。

Gemma 4 的 26B MoE 和 31B Dense,本地跑該選哪個?

26B MoE 幾乎在所有場景都是更好的選擇。它的啟動參數只有 3.8B(推理時不載入所有專家),所以速度快、記憶體效率高,而 benchmark 成績跟 31B Dense 非常接近。除非你有特定任務在 31B 上表現明顯更好,否則選 26B。

Mac 跑 Gemma 4 該用 Ollama 還是 Unsloth MLX?

看你的記憶體夠不夠。如果你的 Mac 有 24GB 以上統一記憶體,Ollama 夠用、速度也快。如果只有 16GB 想跑 26B,Unsloth 的 MLX 版本省 40% 記憶體可能是唯一的選擇。

本地跑的 Gemma 4 品質跟 API 版本一樣嗎?

BF16(完整精度)版本跟 API 版本品質相同。Q8 量化損失幾乎不可察覺。Q4 在大多數任務上品質也很好,但在數學推理和長文本生成上可能有 2-5% 的品質下降。

下一步

本地部署只是起點。你可能還想了解:

- Gemma 4 完整指南:了解 Gemma 4 的完整模型家族和核心功能

- Gemma 4 硬體需求完整對照:更詳細的硬體配置建議

- Gemma 4 微調指南:用 Unsloth 和 LoRA 微調你的專屬模型

準備把 Gemma 4 導入你的企業流程?預約免費架構諮詢,從模型選型、硬體規劃到部署上線,我們提供端到端的技術支援。

相關文章

Gemma 4 31B 在 Mac 上怎麼跑?Apple Silicon 完整部署指南

2026 年在 Apple Silicon Mac 上跑 Gemma 4 31B 的完整指南:統一記憶體優勢、M4/M4 Pro/M4 Max 硬體配置建議、Ollama vs MLX 框架比較、三種預算方案、安裝教學與社群實測數據。

AI 開發工具Gemma 4 硬體需求完整對照:從手機到 H100,選對配備不踩雷

2026 年 Gemma 4 四款模型的硬體需求完整對照表:E2B 手機可跑、E4B 筆電就夠、26B MoE 需 24GB GPU、31B Dense 需 80GB H100。含量化精度比較、消費級硬體實測、伺服器配置建議。

AI 開發工具Gemma 4 API 串接教學:Vertex AI 與 Google AI Studio 實戰

2026 年 Gemma 4 API 串接完整教學:Google AI Studio 免費快速上手 vs Vertex AI 企業級部署。含 Python 程式碼範例、多模態輸入、Function Calling、系統提示設定與 API 定價優化策略。