Gemma 4 硬體需求完整對照:從手機到 H100,選對配備不踩雷

Gemma 4 硬體需求完整對照:從手機到 H100,選對配備不踩雷

TL;DR: Gemma 4 E2B 只要 1.5GB 記憶體就能在手機上跑,E4B 用 6GB VRAM 的筆電就夠,26B MoE 在 4-bit 量化下需要 16-18GB VRAM(RTX 4090 剛好),31B Dense 完整精度需要 62GB(H100 一張搞定)。選對量化等級,消費級硬體也能跑大模型。

「我的電腦跑得動 Gemma 4 嗎?」這大概是 2026 年 4 月 2 日 Gemma 4 發布後,我被問最多的一個問題。

答案取決於三件事:你要跑哪個版本、用什麼量化精度、以及你願意犧牲多少推理品質。這篇文章會把這三個變數的所有排列組合攤開來講清楚,讓你不用買錯硬體、不用踩雷。

不確定該用哪款 Gemma 4 模型?預約免費 AI 諮詢,讓我們的顧問團隊根據你的場景推薦最適合的硬體配置。

想先了解 Gemma 4 的完整功能和架構?請參考 Gemma 4 完整指南。

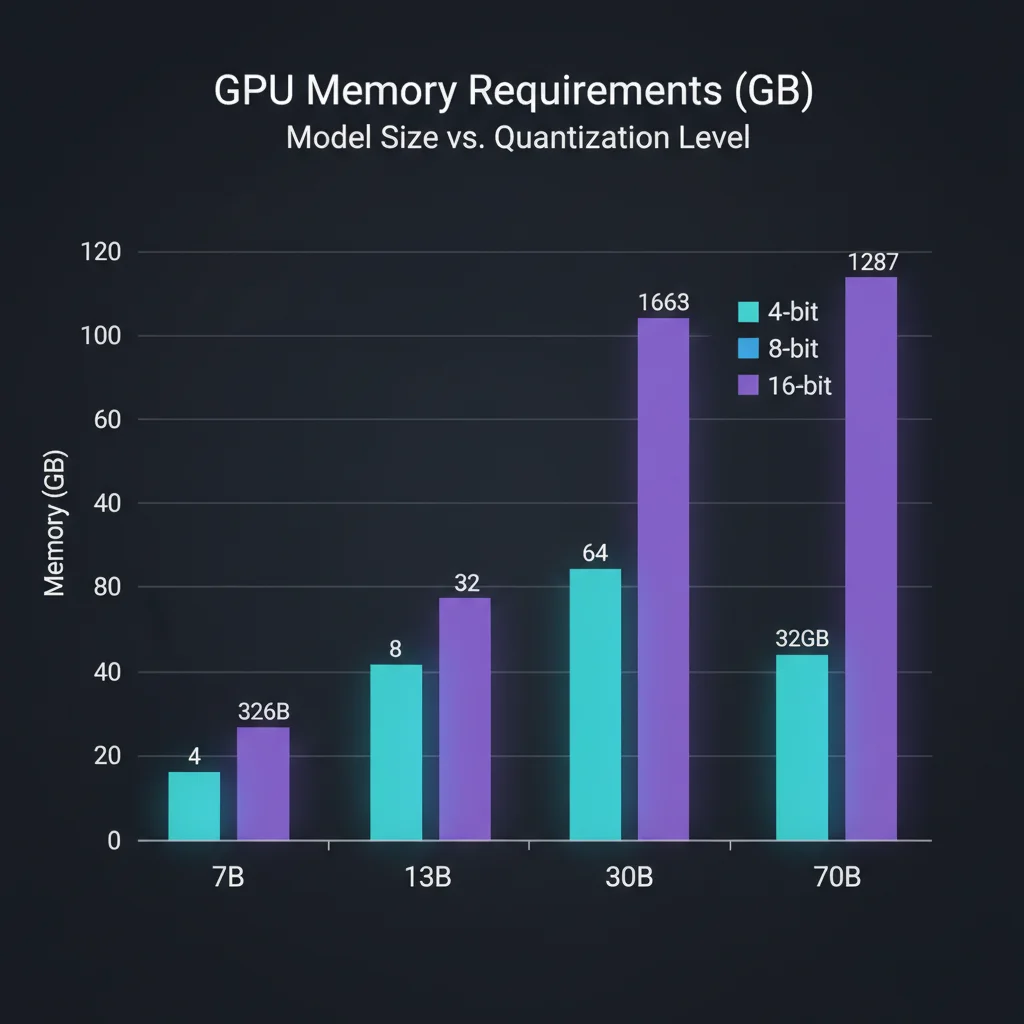

Gemma 4 四款模型的記憶體需求速查表

先給結論。以下是四款 Gemma 4 模型在三種常見量化精度下的記憶體需求,數據來自社群實測和 Unsloth 官方 GGUF 發布:

| 模型 | 4-bit (Q4_K_M) | 8-bit (Q8_0) | BF16(完整精度) |

|---|---|---|---|

| E2B (2.3B) | ~1.5 GB | ~2.5 GB | ~4.6 GB |

| E4B (4.3B) | ~3 GB | ~4.5 GB | ~8.6 GB |

| 26B MoE (A4B) | ~16 GB | ~27 GB | ~50 GB |

| 31B Dense | ~18 GB | ~33 GB | ~62 GB |

幾個關鍵觀察:

E2B 是真正的「口袋模型」。 4-bit 量化後只要 1.5GB,LiteRT 框架甚至支援 2-bit 量化,壓到 1GB 以下。一支中階 Android 手機就能跑。

26B MoE 和 31B Dense 在 4-bit 下的 VRAM 需求很接近。 雖然 26B 的總參數量比 31B 少,但 MoE 架構需要載入所有專家網路的權重,即使每次只啟動 3.8B 參數。所以別以為 26B 就一定比 31B 省記憶體——在 4-bit 量化下,差距其實只有 2GB 左右。

BF16 和 4-bit 的記憶體差距是 3-4 倍。 這代表量化是讓大模型塞進消費級硬體的關鍵技術。但量化不是沒有代價,後面會詳細討論品質影響。

消費級硬體能跑哪些版本?

這是大家最關心的問題:不買伺服器級硬體,到底能跑什麼?

NVIDIA GeForce 系列

| GPU | VRAM | 可跑的最大模型 | 推理速度參考 |

|---|---|---|---|

| RTX 3060 | 12 GB | E4B (Q8)、26B MoE (Q4,勉強) | E4B Q8: ~35 tok/s |

| RTX 3090 | 24 GB | 26B MoE (Q4,舒適)、31B Dense (Q4,勉強) | 26B Q4: ~42 tok/s |

| RTX 4060 Ti | 16 GB | 26B MoE (Q4,剛好) | 26B Q4: ~38 tok/s |

| RTX 4090 | 24 GB | 26B MoE (Q4,舒適)、31B Dense (Q4,勉強) | 26B Q4: ~52 tok/s |

| RTX 5060 Ti | 16 GB | 26B MoE (Q4) | 26B Q4: ~45 tok/s |

| RTX 5090 | 32 GB | 31B Dense (Q4,舒適) | 31B Q4: ~60 tok/s |

RTX 5060 Ti 在 2026 年是性價比之王——429 美元就能跑 26B MoE 的 Q4 版本,這在兩年前是不敢想像的事。

RTX 4090 和 RTX 3090 都有 24GB VRAM,跑 26B MoE Q4(約 16GB)綽綽有餘,還有空間留給 context window。但要跑 31B Dense Q4(約 18GB),剩餘 VRAM 可能不夠處理長文本。

Apple Silicon Mac

| 機型 | 統一記憶體 | 可跑的最大模型 | 推理速度參考 |

|---|---|---|---|

| M1/M2 (8GB) | 8 GB | E4B (Q4) | E4B Q4: ~20 tok/s |

| M1/M2 (16GB) | 16 GB | 26B MoE (Q4,緊) | 26B Q4: ~15 tok/s |

| M3/M4 (24GB) | 24 GB | 26B MoE (Q4,舒適) | 26B Q4: ~25 tok/s |

| M4 Pro (48GB) | 48 GB | 31B Dense (Q8) | 31B Q8: ~20 tok/s |

| M4 Max (128GB) | 128 GB | 31B Dense (BF16) | 31B BF16: ~15 tok/s |

Mac 的優勢是統一記憶體架構——CPU 和 GPU 共用同一塊記憶體,不像 NVIDIA 顯卡有獨立 VRAM 的限制。M4 Max 的 128GB 統一記憶體甚至可以跑 31B Dense 的完整精度版本,不需要量化。

但 Mac 的劣勢也很明顯:記憶體頻寬。M4 Max 的 546 GB/s 聽起來很猛,但跟 H100 的 3.35 TB/s 比起來還是差了一個數量級。所以同樣跑 31B BF16,Mac 的推理速度會慢很多。

建議用 MLX 框架跑 Mac 上的推理,比 llama.cpp 快 30-50%。

需要幫你評估現有硬體能跑什麼模型?聯繫我們的技術團隊,免費提供硬體配置建議。

手機與平板:E2B 和 E4B 的邊緣部署

Gemma 4 最讓我驚喜的一點,是 E2B 真的能在手機上順暢運行。不是那種「技術上可以跑但慢到沒法用」的程度,而是真的可以做即時對話的水準。

Android 部署

Google 在 Gemma 4 發布當天就推出了 AI Edge Gallery app,你可以直接從 app 裡下載 E2B 和 E4B 模型,不需要任何技術設定。

對開發者來說,LiteRT-LM 框架是更深層的整合方案。它支援 2-bit 和 4-bit 量化,加上 memory-mapped per-layer embeddings,E2B 在某些裝置上只需不到 1.5GB 記憶體。一支搭載 Snapdragon 8 Gen 4 的旗艦 Android 手機,跑 E2B 可以達到 15-20 tok/s。

iOS 部署

好消息:AI Edge Gallery 現在也支援 iOS 了。iPhone 15 Pro 以上的機型(6GB RAM)可以跑 E2B Q4,iPhone 16 Pro(8GB RAM)可以跑 E4B Q4。

實際應用場景

- E2B 適合:語音助手、即時翻譯、簡單問答、IoT 裝置控制

- E4B 適合:文件摘要、進階對話、圖片理解、離線搜尋

一個重要提醒:手機跑 AI 模型會產生大量熱能。持續推理超過 5 分鐘,多數手機會開始降頻。實際部署時要做好散熱測試和 throttling 策略。

想了解完整的本地部署教學?請參考 Gemma 4 本地部署指南。

伺服器級硬體:26B MoE 和 31B Dense 怎麼配

如果你要在生產環境部署 Gemma 4,消費級硬體就不太夠用了。以下是伺服器級 GPU 的配置建議:

單卡部署方案

| GPU | VRAM | 適合模型 | 月租成本參考 |

|---|---|---|---|

| NVIDIA L40S | 48 GB | 26B MoE (Q8)、31B Dense (Q4) | ~$655/月 (INT8) |

| NVIDIA A100 | 80 GB | 31B Dense (BF16) | ~$0.61/hr (spot) |

| NVIDIA H100 | 80 GB | 31B Dense (BF16),高並發 | ~$0.99/hr (spot) |

L40S 是中小企業的甜蜜點。 48GB VRAM 足以跑 26B MoE 的 Q8 版本(27GB),甚至 31B Dense 的 Q4 版本(18GB)加上充裕的 KV cache 空間。每月約 655 美元的成本,比 H100 便宜將近 50%。

H100 是高並發場景的標準選擇。 3.35 TB/s 的記憶體頻寬讓它在處理多用戶同時推理時,吞吐量遠超 A100(2 TB/s)和 L40S(864 GB/s)。如果你需要同時服務 50+ 個請求,H100 的 BF16 方案是最穩定的。

A100 是性價比折衷方案。 80GB VRAM 跟 H100 一樣,但價格更低。缺點是頻寬和 Tensor Core 效能都不如 H100,高並發時延遲會上升。

多卡配置

如果你需要跑 31B Dense BF16(62GB)但只有 A100 40GB 的機器,可以用 tensor parallelism 把模型分割到兩張卡上。vLLM 和 TensorRT-LLM 都支援這個功能,但會增加約 10-15% 的延遲。

我的建議

| 場景 | 推薦配置 | 理由 |

|---|---|---|

| MVP / 小流量 | L40S + 26B MoE Q8 | 成本低、品質好 |

| 生產 / 中流量 | A100 80GB + 31B Dense BF16 | 最佳品質、合理成本 |

| 高並發 / 嚴格 SLA | H100 + 31B Dense BF16 | 最高吞吐量 |

需要伺服器級 Gemma 4 部署方案?預約技術諮詢,我們提供從選型到上線的全流程支援。

量化對品質的影響:4-bit 夠用嗎?

這是每個人都會問的問題:量化到底會損失多少品質?

量化等級與品質損失

Gemma 4 的架構在設計時就考慮了量化友善性,所以它比很多同級模型更耐量化。根據社群實測:

| 量化等級 | 記憶體節省 | 品質損失 | 適用場景 |

|---|---|---|---|

| BF16(無量化) | 基準 | 無 | 研究、品質敏感的生產環境 |

| Q8_0(8-bit) | ~50% | 幾乎無感 (<1%) | 生產環境的黃金標準 |

| Q6_K(6-bit) | ~62% | 極小 (~1-2%) | 品質與效率的最佳平衡 |

| Q4_K_M(4-bit) | ~75% | 可感知 (~3-5%) | VRAM 有限時的最佳選擇 |

| Q2_K(2-bit) | ~87% | 明顯 (~10-15%) | 僅限邊緣裝置、非關鍵任務 |

什麼時候 4-bit 夠用?

夠用的場景:

- 一般對話和問答

- 程式碼生成和除錯

- 文件摘要

- 創意寫作

不夠用的場景:

- 複雜的數學推理(AIME 分數在 Q4 下會掉 5-8%)

- 多步驟邏輯推理

- 需要精確數字輸出的任務

- 專業領域的微調後部署

NVIDIA NVFP4 的突破

NVIDIA 在 Blackwell 架構上推出的 NVFP4 格式值得特別關注。它是硬體原生的 4-bit 浮點格式,比傳統的 Q4 整數量化在精度保持上更好。如果你用的是 RTX 5090 或 Blackwell 伺服器 GPU,NVFP4 可以在 4-bit 的記憶體佔用下,達到接近 8-bit 的品質。

我的量化選擇建議

- VRAM 充足(48GB+)→ Q8 或 BF16

- VRAM 有限(16-24GB)→ Q4_K_M,確保足夠

- 邊緣裝置(4-8GB)→ Q4 或更低,搭配 LiteRT

想了解如何微調 Gemma 4 來彌補量化損失?請參考 Gemma 4 微調指南。

常見問題

我的 RTX 3060 12GB 能跑 Gemma 4 嗎?

可以,但要看版本。E2B 和 E4B 的所有量化版本都沒問題。26B MoE Q4 約需 16GB,超過 3060 的 12GB VRAM,所以跑不了。你最大能跑的是 E4B 的 BF16 完整精度版(約 8.6GB),這已經是一個非常有能力的模型了。

Mac Mini M4 (24GB) 跑 26B MoE 效果怎麼樣?

跑得動,而且體驗不錯。26B MoE Q4 約需 16GB,24GB 的統一記憶體還剩 8GB 給系統和 KV cache。用 MLX 框架可以達到約 25 tok/s 的生成速度,日常對話和開發輔助完全夠用。唯一要注意的是超長 context(>32K tokens)時可能會 OOM。

量化後的模型可以微調嗎?

可以,但通常建議用 QLoRA(Quantized LoRA)的方式。你載入 4-bit 量化的基底模型,然後在 LoRA adapter 上用 BF16 精度訓練。這樣只需要額外 2-4GB VRAM,就能在量化模型上做高品質微調。Unsloth 框架對 Gemma 4 的 QLoRA 支援特別好。

H100 和 A100 跑 Gemma 4 31B 差多少?

主要差在吞吐量和並發能力。單一請求的延遲差距約 20-30%,但在 32 個並發請求下,H100 的吞吐量可以是 A100 的 1.5-2 倍。如果你只是做開發測試,A100 完全夠用;如果要上生產服務多用戶,H100 的投資是值得的。

相關文章

Gemma 4 31B 在 Mac 上怎麼跑?Apple Silicon 完整部署指南

2026 年在 Apple Silicon Mac 上跑 Gemma 4 31B 的完整指南:統一記憶體優勢、M4/M4 Pro/M4 Max 硬體配置建議、Ollama vs MLX 框架比較、三種預算方案、安裝教學與社群實測數據。

AI 開發工具Gemma 4 本地部署教學:Ollama、LM Studio、Unsloth 三種方式完整攻略

2026 年如何在本地跑 Gemma 4?完整教學三種部署方式:Ollama 五分鐘快速上手、LM Studio 圖形化零門檻、Unsloth 進階推理+微調。含硬體需求、量化選擇與常見問題排除。

AI 開發工具Gemma 4 完整指南:2026 年最強開源模型從入門到實戰

2026 年 Google 發布 Gemma 4 開源模型,Apache 2.0 授權、四種尺寸(E2B 到 31B)、256K context window、多模態支援。完整解析架構、部署、微調、API 串接與企業導入策略。