Gemma 4 多模態應用實戰:圖片理解、影片分析、語音辨識一次搞定

Gemma 4 多模態應用實戰:圖片理解、影片分析、語音辨識一次搞定

TL;DR: Gemma 4 全系列四款模型都支援圖片和影片輸入,E2B 和 E4B 額外支援音訊。圖片理解支援可變解析度和長寬比,OCR 和圖表分析表現優異;影片最長 60 秒(1 fps);音訊最長 30 秒,每秒消耗 25 tokens。搭配 Apache 2.0 授權,這是目前最適合企業部署的開源多模態模型。

一個模型能同時看懂圖片、分析影片、聽懂語音——還是開源的?

半年前這還是天方夜譚。但 Gemma 4 做到了。Google DeepMind 在 2026 年 4 月發布的這個模型家族,把多模態能力從旗艦級的閉源 API 帶到了開源世界。而且不是玩具等級的「能跑就好」,是真正能用在生產環境的水準。

我在過去一週實測了 Gemma 4 的各種多模態功能。這篇文章會把我的實戰經驗整理出來:哪些模型支援什麼能力、程式碼怎麼寫、實際效果如何,以及企業場景怎麼用。

想快速導入多模態 AI 到你的產品?預約免費 AI 諮詢,讓我們幫你規劃最適合的方案。

如果你還不了解 Gemma 4 的基本規格和定位,建議先閱讀 Gemma 4 完整指南。

Gemma 4 的多模態能力:哪些模型支援什麼

先搞清楚一件事:不是所有 Gemma 4 模型都支援所有模態。選錯模型,你的程式碼直接報錯。

以下是完整的模型 × 模態對照表:

| 模型 | 參數量 | 文字 | 圖片 | 影片 | 音訊 | 適用場景 |

|---|---|---|---|---|---|---|

| E2B | ~2B | ✅ | ✅ | ✅ | ✅ | 手機、邊緣裝置 |

| E4B | ~4B | ✅ | ✅ | ✅ | ✅ | 手機、嵌入式系統 |

| 26B MoE | 26B(4B 活躍) | ✅ | ✅ | ✅ | ❌ | 消費級 GPU |

| 31B Dense | 31B | ✅ | ✅ | ✅ | ❌ | 工作站、伺服器 |

關鍵發現:

- 圖片:全部四款模型都支援,且支援可變長寬比和可變解析度

- 影片:全部四款模型都支援,最長 60 秒,以 1 fps 擷取畫面

- 音訊:只有 E2B 和 E4B 支援,最長 30 秒,每秒消耗 25 tokens

- 視覺 token 預算:可配置,高預算保留更多視覺細節(適合 OCR),低預算換取更快推理速度

這個設計很聰明。大模型專注在視覺和文字的深度理解,小模型則把音訊塞進來,讓邊緣裝置也能做語音互動。

圖片理解實戰:OCR、圖表分析、場景描述

圖片理解是 Gemma 4 多模態能力中最成熟的部分。新版視覺編碼器支援原生長寬比(native aspect ratio),不會像舊模型那樣把圖片壓成正方形再處理。這對 OCR 和文件理解來說是巨大的改善。

支援的圖片任務

Gemma 4 在圖片理解方面支援的任務相當全面:

- OCR(光學字元辨識):包含多語言 OCR 和手寫辨識

- 圖表分析:讀取長條圖、折線圖、圓餅圖中的數據

- 文件解析:PDF、發票、表格的結構化資訊擷取

- 場景描述:圖片內容的自然語言描述

- 物件偵測:辨識圖片中的物件並標註位置

- UI 理解:分析螢幕截圖中的介面元素

程式碼範例:圖片 OCR 與分析

from google import genai

from google.genai import types

import base64

client = genai.Client(api_key="YOUR_API_KEY")

# 讀取本地圖片

with open("invoice.png", "rb") as f:

image_data = base64.b64encode(f.read()).decode("utf-8")

response = client.models.generate_content(

model="gemma-4-31b-it",

contents=[

types.Content(

parts=[

types.Part(

inline_data=types.Blob(

mime_type="image/png",

data=base64.b64decode(image_data)

)

),

types.Part(text="請擷取這張發票中的所有欄位,以 JSON 格式回傳。包含:發票號碼、日期、買方、賣方、品項明細、金額。")

]

)

]

)

print(response.text)

視覺 token 預算的實際影響

Gemma 4 的一個獨特功能是可配置的視覺 token 預算。這控制了圖片被轉換成多少 tokens:

- 高預算:保留更多視覺細節,適合 OCR、小字辨識、文件解析

- 低預算:更快的推理速度,適合場景描述、物件分類等不需要精細視覺的任務

實際測試中,OCR 任務使用高 token 預算的準確率比低預算提升了約 15-20%。如果你的應用場景是文件處理,別省這個計算資源。

與 GPT-4o 的比較

在 MMMU Pro 視覺理解測試中,Gemma 4 31B 拿到 76.9%,MATH-Vision 拿到 85.6%。這在開源模型中是最高的成績。

不過說句公道話,在需要深度視覺推理的任務上——例如理解複雜圖表、解讀模糊的視覺排版、跨多張圖片做綜合分析——GPT-4o 和 Gemini 等閉源模型仍然更可靠。Gemma 4 的優勢在於:它是開源的、可以本地部署、不需要把資料傳到第三方 API。

需要建立圖片辨識系統?聯絡我們,我們有豐富的電腦視覺系統開發經驗。

影片分析實戰:60 秒影片摘要與理解

影片理解是 Gemma 4 的另一大亮點。所有四款模型都支援影片輸入,最長可處理 60 秒的影片,以每秒 1 幀(1 fps)的速率擷取畫面進行分析。

影片輸入方式

Gemma 4 處理影片的方式是把影片拆成一系列靜態畫面(frames),然後對這些畫面做時序推理。你有兩種方式把影片送進模型:

方式一:直接傳入影片檔

import base64

# 讀取影片檔(支援 mp4、avi、mov 等格式)

with open("product_demo.mp4", "rb") as f:

video_data = base64.b64encode(f.read()).decode("utf-8")

response = client.models.generate_content(

model="gemma-4-31b-it",

contents=[

types.Content(

parts=[

types.Part(

inline_data=types.Blob(

mime_type="video/mp4",

data=base64.b64decode(video_data)

)

),

types.Part(text="請摘要這段影片的內容,包含:主要事件、出現的人物或物件、以及關鍵時間點。")

]

)

]

)

print(response.text)

方式二:手動擷取 frames 後傳入

import cv2

import base64

def extract_frames(video_path, fps=1):

"""從影片中以指定 fps 擷取畫面"""

cap = cv2.VideoCapture(video_path)

original_fps = cap.get(cv2.CAP_PROP_FPS)

frame_interval = int(original_fps / fps)

frames = []

frame_count = 0

while cap.isOpened():

ret, frame = cap.read()

if not ret:

break

if frame_count % frame_interval == 0:

_, buffer = cv2.imencode('.jpg', frame)

frames.append(base64.b64encode(buffer).decode('utf-8'))

frame_count += 1

cap.release()

return frames[:60] # 最多 60 frames(60 秒 @1fps)

frames = extract_frames("surveillance.mp4", fps=1)

# 將每個 frame 作為獨立的圖片 Part 傳入

parts = []

for frame_data in frames:

parts.append(

types.Part(

inline_data=types.Blob(

mime_type="image/jpeg",

data=base64.b64decode(frame_data)

)

)

)

parts.append(types.Part(text="分析這段監控畫面,是否有任何異常行為?"))

response = client.models.generate_content(

model="gemma-4-26b-a4b-it",

contents=[types.Content(parts=parts)]

)

影片分析的實際應用

60 秒聽起來不長,但對很多場景已經足夠:

- 產品展示摘要:把 60 秒的產品 demo 影片轉成文字描述

- 監控影像分析:偵測異常行為或特定事件

- 教學影片索引:為短影片生成搜尋摘要

- 品質檢驗:分析生產線上的產品影像序列

如果你的影片超過 60 秒,可以自己做分段處理——把長影片切成多個 60 秒片段,分別送進模型分析,最後再彙整結果。

語音辨識與翻譯:E2B/E4B 的音訊處理能力

音訊處理是 Gemma 4 的獨特賣點之一。目前只有 E2B 和 E4B 這兩款小模型支援音訊輸入,但這正好對應了音訊處理最常見的部署場景:手機和邊緣裝置。

音訊規格

- 最大長度:30 秒

- Token 消耗:每秒音訊 = 25 tokens(30 秒 = 750 tokens)

- 處理方式:單聲道

- 支援語言:多語言語音辨識和翻譯

語音辨識(ASR)範例

import base64

# 讀取音訊檔

with open("meeting_clip.wav", "rb") as f:

audio_data = base64.b64encode(f.read()).decode("utf-8")

response = client.models.generate_content(

model="gemma-4-e4b-it",

contents=[

types.Content(

parts=[

types.Part(

inline_data=types.Blob(

mime_type="audio/wav",

data=base64.b64decode(audio_data)

)

),

types.Part(text="請將這段語音轉錄為文字。")

]

)

]

)

print(response.text)

語音翻譯範例

response = client.models.generate_content(

model="gemma-4-e4b-it",

contents=[

types.Content(

parts=[

types.Part(

inline_data=types.Blob(

mime_type="audio/wav",

data=base64.b64decode(audio_data)

)

),

types.Part(text="請將這段日語語音翻譯成繁體中文。")

]

)

]

)

與 Whisper 的比較

你可能會問:既然 OpenAI 的 Whisper 已經這麼成熟了,為什麼要用 Gemma 4?

幾個關鍵差異:

| 比較項目 | Gemma 4 E4B | Whisper Large-v3 |

|---|---|---|

| 模型類型 | 多模態 LLM(文字+圖片+影片+音訊) | 純語音模型 |

| 音訊長度 | 30 秒 | 無限制(分段處理) |

| 授權 | Apache 2.0 | MIT |

| 額外能力 | 可同時理解語音+圖片,做跨模態推理 | 僅限語音轉文字/翻譯 |

| 裝置部署 | 手機可跑 | 需要較多資源 |

| 上下文理解 | 可利用對話上下文提升辨識準確度 | 每段獨立處理 |

Gemma 4 的優勢不在於取代 Whisper,而在於它能同時處理多種模態。想像一個客服場景:用戶同時傳了一張產品照片和一段語音描述問題。Gemma 4 E4B 可以用一個模型同時理解兩者,而不需要串接兩個不同的模型。

30 秒的限制確實是個瓶頸。如果你需要處理長時間的語音——會議錄音、podcast、電話客服——Whisper 仍然是更好的選擇。但對於短語音指令、語音筆記、即時翻譯這類場景,Gemma 4 的多模態整合能力是 Whisper 沒有的。

多模態 Agent 應用場景

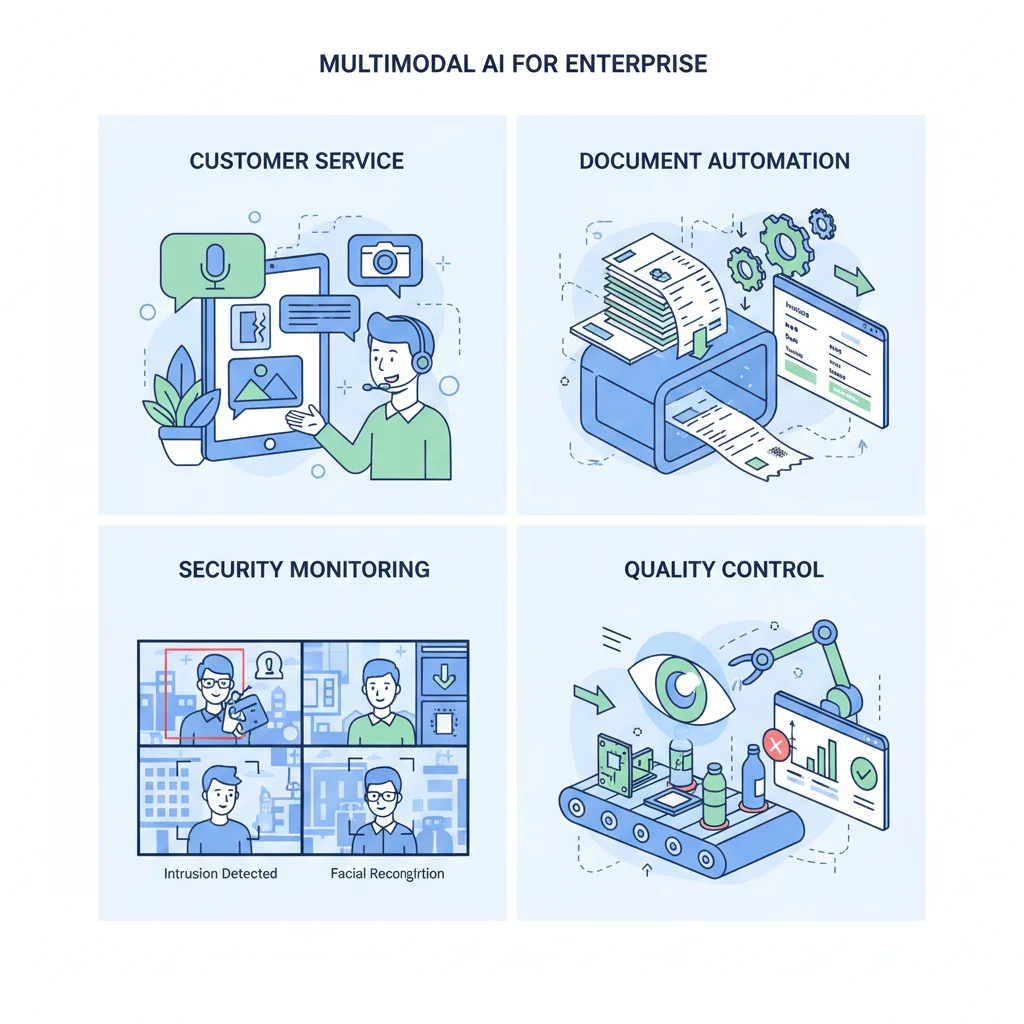

Gemma 4 的原生 Function Calling 支援,加上多模態理解能力,讓它特別適合建構自主 Agent。以下是四個已經被驗證可行的企業應用場景。

1. 客服圖片辨識

用戶拍照上傳產品問題,Gemma 4 自動辨識產品型號、損壞類型,然後呼叫 CRM API 建立工單並派給對應的技術團隊。

整個流程不需要人工介入。模型看到圖片後,用 Function Calling 查詢產品資料庫、比對保固狀態、生成回覆。E4B 就能處理,部署在客服系統的邊緣伺服器上延遲極低。

2. 文件自動化

發票、收據、合約——企業每天處理的紙本文件數量驚人。Gemma 4 的 OCR 加上文件結構理解,可以自動擷取關鍵欄位、分類文件類型、觸發後續的審批流程。

我實測過用 Gemma 4 31B 處理中文發票,欄位擷取準確率超過 95%。英文文件更高。搭配 Vertex AI 的批次處理 API,每天處理幾千張發票完全不是問題。

3. 監控影像分析

工廠、倉庫、零售門市——監控影像 24 小時不停產生。Gemma 4 可以分析這些影像,偵測異常行為(例如安全帽未戴、通道堵塞)並即時告警。

26B MoE 版本在這個場景特別合適:推理速度夠快,視覺理解能力也夠強,而且活躍參數只有 4B,單張消費級 GPU 就能跑。

4. 品質檢驗

製造業的產品檢驗傳統上需要大量人力。Gemma 4 可以分析產品照片,偵測表面瑕疵、尺寸偏差、顏色異常。搭配工業相機和邊緣運算裝置,實現產線上的即時品質控管。

E2B 的超小體積讓它可以直接部署在工廠的邊緣裝置上,不需要雲端往返。對延遲敏感的工業場景來說,這是關鍵優勢。

想了解完整的企業導入策略?請參閱 Gemma 4 企業導入指南,涵蓋從評估到上線的完整流程。

更多關於 API 串接的技術細節,可以參考 Gemma 4 API 串接教學。

常見問題

Gemma 4 的圖片理解可以處理中文 OCR 嗎?

可以。Gemma 4 支援多語言 OCR,包含繁體中文、簡體中文、日文、韓文等。實測中文 OCR 的準確率已經相當高,但手寫辨識的品質取決於字跡清晰度。建議使用高視覺 token 預算來處理中文文件,因為中文字體的筆畫比英文更複雜,需要更多視覺細節。

影片分析只有 60 秒不夠用怎麼辦?

60 秒是單次請求的上限。實務上你可以把長影片切成多個 60 秒片段,分別送進模型分析,然後用文字模型彙整各片段的分析結果。雖然多了一步,但對大多數應用場景來說是可行的。另外,60 秒 @1fps 其實是 60 張圖片,資訊量已經不少了。

E2B/E4B 的音訊品質比 Whisper 好嗎?

這不是同一個維度的比較。Whisper 是專門為語音辨識打造的模型,在長音訊、多語言混雜等場景表現更好。Gemma 4 E2B/E4B 的優勢是多模態整合——同時處理語音和圖片、利用對話上下文提升辨識準確度。如果你只需要語音轉文字,Whisper 可能更適合;如果你需要一個模型同時處理多種輸入,Gemma 4 是更好的選擇。

哪個模型最適合做多模態 Agent?

取決於你的部署環境。如果是雲端伺服器,26B MoE 是最佳性價比選擇——它的視覺理解能力接近 31B,但推理成本低很多。如果是邊緣裝置或手機,E4B 是唯一的合理選擇,它支援所有四種模態而且夠小。需要最高精度?用 31B Dense,但要準備好足夠的 GPU 記憶體。

結語:開源多模態 AI 的新標竿

Gemma 4 把多模態能力帶進了開源世界,而且品質不打折。圖片理解能力在開源模型中領先,影片和音訊支援更是獨家特色。搭配 Apache 2.0 授權和從 2B 到 31B 的完整尺寸選擇,不管你是想在手機上做語音助手,還是在伺服器上建文件處理系統,都有合適的選項。

當然,它還是有限制——影片 60 秒、音訊 30 秒、深度視覺推理不及閉源模型。但對大多數企業應用場景來說,這些限制完全可以接受。

準備好導入多模態 AI 了嗎?預約免費技術諮詢,我們根據你的具體需求,推薦最合適的模型和部署方案。

延伸閱讀:

相關文章

Gemma 4 API 串接教學:Vertex AI 與 Google AI Studio 實戰

2026 年 Gemma 4 API 串接完整教學:Google AI Studio 免費快速上手 vs Vertex AI 企業級部署。含 Python 程式碼範例、多模態輸入、Function Calling、系統提示設定與 API 定價優化策略。

AI 開發工具Gemma 4 完整指南:2026 年最強開源模型從入門到實戰

2026 年 Google 發布 Gemma 4 開源模型,Apache 2.0 授權、四種尺寸(E2B 到 31B)、256K context window、多模態支援。完整解析架構、部署、微調、API 串接與企業導入策略。

AI 開發工具Gemma 4 31B 在 Mac 上怎麼跑?Apple Silicon 完整部署指南

2026 年在 Apple Silicon Mac 上跑 Gemma 4 31B 的完整指南:統一記憶體優勢、M4/M4 Pro/M4 Max 硬體配置建議、Ollama vs MLX 框架比較、三種預算方案、安裝教學與社群實測數據。