Claude Code 原始碼洩漏事件完整解析:2026 年 AI 產業最大資安烏龍

Claude Code 原始碼洩漏事件完整解析:2026 年 AI 產業最大資安烏龍

一家標榜「AI 安全」的公司,卻連自己的程式碼都保護不好

2026 年 3 月 31 日凌晨,Anthropic 犯了一個價值數十億美元的錯誤。

他們把 Claude Code 的完整原始碼——51 萬行 TypeScript,包含未公開功能、內部代號、反競爭機制——全部放進了一個公開的 npm 套件裡。不是被駭客入侵,不是內部人員洩密,就是打包發布時的人為疏失。

更尷尬的是,這已經是一週內的第二次重大資安事故。五天前,Anthropic 才被 Fortune 爆出將近 3,000 份內部文件存放在不安全的資料庫中。

你可能會想:一家估值超過 600 億美元、以 AI 安全為核心品牌的公司,怎麼會犯這麼基本的錯?這篇文章帶你完整了解這起事件的來龍去脈,以及它對整個 AI 開發工具產業的影響。

想了解如何安全地導入 AI 開發工具到你的團隊?預約免費 AI 諮詢,讓 CloudInsight 專業團隊為你評估最佳方案。

TL;DR

2026 年 3 月 31 日,Anthropic 在發布 Claude Code v2.1.88 時,npm 套件中夾帶了一個 59.8 MB 的 source map 檔案,指向完整原始碼。數小時內,51 萬行 TypeScript 被全球開發者鏡像備份,韓國開發者更在 2 小時內用 Python 完成 clean-room 重寫(claw-code),創下 GitHub 史上最快突破 5 萬 stars 的紀錄。

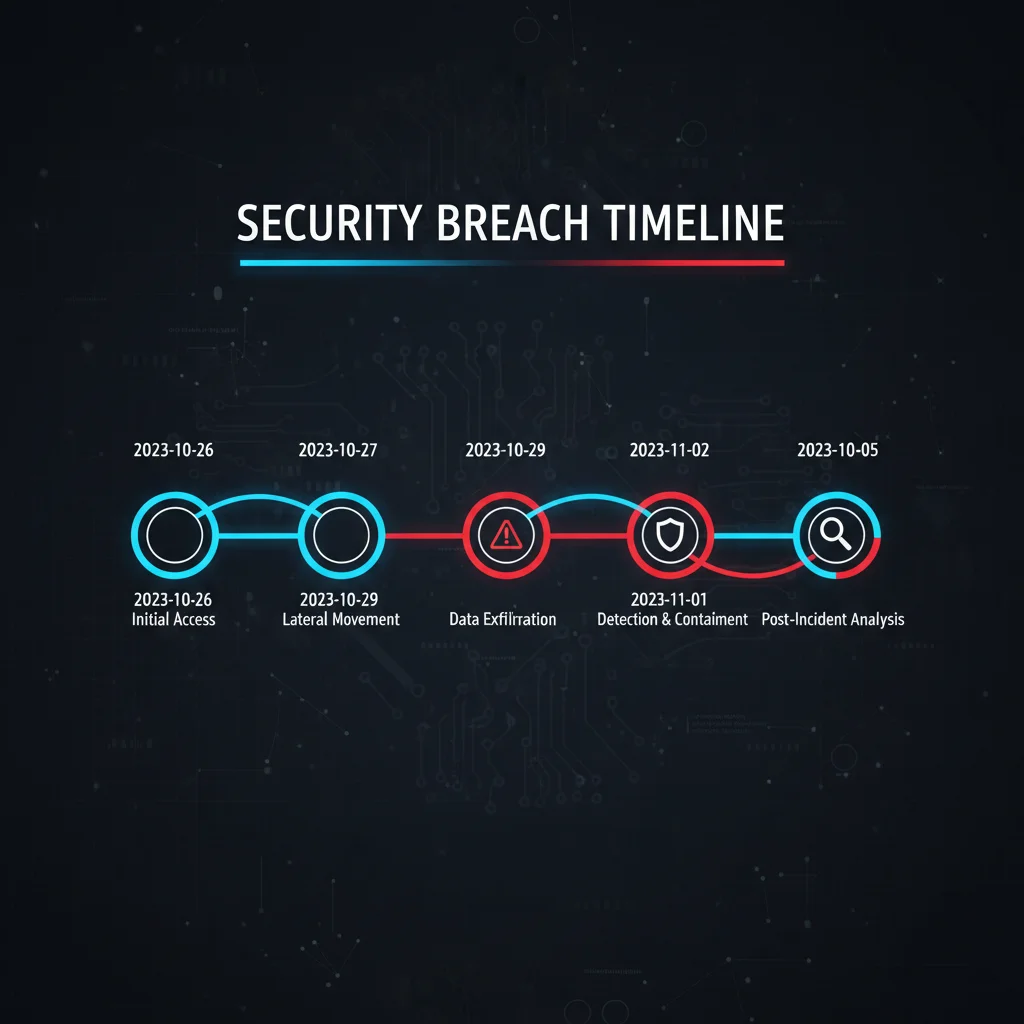

事件完整時間線:從第一次洩漏到全面曝光

Answer-First: 這不是 Claude Code 第一次因為 source map 問題洩漏原始碼。早在 2025 年 2 月就發生過一次,但 Anthropic 沒有徹底修復根因。2026 年 3 月,同樣的問題再次爆發,而且規模更大。

前情提要:被忽視的警訊

| 時間 | 事件 |

|---|---|

| 2025 年 2 月 | Claude Code 早期版本因 source map 遺留,首次發生原始碼洩漏 |

| 2026 年 3 月 10 日 | 內部備忘錄記錄每天浪費 25 萬次 API 呼叫的 bug |

| 2026 年 3 月 11 日 | 有人針對 Bun 打包工具在 production 模式下生成 source map 的問題提交了 bug report |

| 2026 年 3 月 21 日 | Anthropic 向開源替代品 OpenCode 發出法律威脅信 |

看出問題了嗎?source map 的 bug 早在 3 月 11 日就被回報了,但 20 天後的正式發布仍然沒修。

事件爆發

| 時間(UTC) | 事件 |

|---|---|

| 3 月 31 日 00:21 | Claude Code v2.1.88 推送至 npm,夾帶 59.8 MB 的 JavaScript source map |

| 3 月 31 日 ~08:23 | 安全研究員 Chaofan Shou 在 X/Twitter 上公開披露 |

| 數小時內 | 51 萬行 TypeScript 被鏡像至多個 GitHub 倉庫 |

| 3 月 31 日日出前 | 韓國開發者 Sigrid Jin 用 Python 完成 clean-room 重寫,推出 claw-code |

| 約 2 小時後 | claw-code 突破 50,000 GitHub stars |

| 3 月 31 日 03:29 | Anthropic 移除問題版本 |

| 隨後 | Anthropic 對 GitHub 鏡像倉庫發出 DMCA 下架通知 |

從洩漏到被發現,中間隔了大約 8 小時。從被發現到原始碼被完整鏡像,只花了幾小時。在網路時代,8 小時的反應時間等於永恆。

到底洩漏了什麼?六大關鍵發現

Answer-First: 洩漏的不只是程式碼本身。更有價值的是藏在程式碼裡的未發布功能、內部代號、以及一些引發爭議的隱藏機制。以下是安全研究員和開發者社群挖出的六大發現。

發現一:KAIROS 自主守護模式

在洩漏的程式碼中,「KAIROS」這個 feature flag 被提及超過 150 次。KAIROS 是古希臘語「恰當的時機」,而在 Claude Code 內部,它代表一個尚未上線的自主背景代理模式。

我第一次看到這段程式碼時,老實說有點被嚇到。它包含:

/dream記憶蒸餾技能——讓 AI 在背景自主整理和壓縮記憶- GitHub webhook 訂閱——自動監控你的倉庫變動

- 背景 daemon worker——持續運行的守護程序

- 五分鐘 cron 排程刷新——定期執行任務

這基本上是一個 7×24 小時替你工作的 AI 開發助手的雛形。

發現二:Undercover Mode(隱身模式)

undercover.ts 這個檔案揭露了一套機制:當 Claude Code 在外部開源倉庫操作時,會指示模型避免提及內部代號(如 "Capybara"、"Tengu")、Slack 頻道,或暗示程式碼是 AI 所撰寫。

更讓人不安的是——沒有強制關閉開關。

這引發了一個嚴肅的問題:Anthropic 是否一直在秘密向開源專案提交 AI 生成的程式碼,且刻意隱瞞這個事實?

發現三:Anti-Distillation 反蒸餾機制

這可能是最具爭議性的發現:

- Fake Tools Injection:透過

tengu_anti_distill_fake_tool_injection開關,注入假的工具定義到 API 流量中,目的是毒化競爭對手從 API 流量中萃取訓練資料的嘗試 - Connector-Text Summarization:緩衝 assistant 回應並加密簽章,隱藏完整推理鏈

簡單來說,Anthropic 設計了一套機制來防止競爭對手「偷學」他們的模型行為。

發現四:Frustration Detection(挫折偵測)

這個比較有趣——一家 LLM 公司竟然用正則表達式來偵測用戶情緒。

程式碼中包含大量正則表達式,用來匹配 "wtf"、"shit"、"this sucks" 等挫折語句。一家以大型語言模型為核心產品的公司,卻選擇用 regex 來做情緒分析,這本身就充滿了諷刺。

發現五:Native Client Attestation(原生客戶端認證)

API 請求中包含 cch=00000 佔位符,由 Bun 的 Zig 層級 HTTP 堆疊替換為計算雜湊值。這基本上是一套類似 DRM 的驗證機制,用來確認請求來自正版 Claude Code 二進位檔。

這等於在技術層面封鎖了第三方客戶端和開源替代品。

發現六:模型代號對照表

洩漏的程式碼揭露了 Anthropic 的內部模型代號:

| 代號 | 對應模型 |

|---|---|

| Capybara | Claude 4.6 變體 |

| Fennec | Opus 4.6 |

| Numbat | 未發布,仍在測試 |

此外還有 44 個 feature flags、6+ 個 killswitch(遠端停用開關) 和一個愚人節限定的電子寵物彩蛋(18 種物種、稀有度分級和 RPG 數值)。

對 AI 開發工具的安全架構有疑慮?與 CloudInsight 資安專家聊聊,我們幫你評估風險。

洩漏的技術原因:一個 Source Map 引發的血案

Answer-First: 根因是 Bun 打包工具在 production 模式下仍然生成 source map 檔案,且發布流程缺乏足夠的檢查機制來攔截這類意外。

什麼是 Source Map?

如果你是前端或 Node.js 開發者,你一定知道 source map。它是一個映射檔案,讓瀏覽器或除錯工具能把壓縮、混淆過的程式碼對應回原始的開發版本。

在開發環境中,source map 是必備的除錯工具。但在生產環境中,它等於是把你的原始碼雙手奉上。

具體發生了什麼?

Claude Code v2.1.88 的 npm 套件中包含了一個 .map 檔案,該檔案指向一個託管在 Anthropic 自有 Cloudflare R2 儲存桶上的 zip 壓縮檔。任何人都可以:

- 安裝 npm 套件

- 找到 source map 檔案

- 下載對應的 zip

- 解壓取得完整的 TypeScript 原始碼

整個流程不需要任何特殊權限或駭客技術。

為什麼沒有被攔截?

這才是最關鍵的問題。合理的 CI/CD pipeline 應該包含:

- 打包後的檔案大小檢查(59.8 MB 的 map 檔明顯異常)

- 敏感檔案掃描(

.map檔案不應該出現在 production build 中) - 發布前的人工審核

但這些機制顯然都不存在,或者沒有正常運作。而且,同樣的問題早在 2025 年 2 月就發生過一次。

Anthropic 的回應

Anthropic 發言人的官方聲明:

"Earlier today, a Claude Code release included some internal source code. This was a release packaging issue caused by human error, not a security breach. We're rolling out measures to prevent this from happening again."

翻譯:這是人為疏失,不是安全入侵。沒有客戶資料或憑證被暴露。我們正在部署防範措施。

但社群並不買帳。原因很簡單:你可以犯一次錯,但同樣的錯犯兩次,就是流程的系統性問題。

Anthropic 也對 GitHub 上的直接鏡像倉庫發出了 DMCA 下架通知。但由於 claw-code 是 clean-room 重寫(Python/Rust),不構成著作權侵害,因此無法被 DMCA 下架。

claw-code:史上最快突破 5 萬 Stars 的 GitHub 專案

Answer-First: 韓國開發者 Sigrid Jin 在洩漏消息傳出後數小時內,使用工具將核心架構用 Python 從零重寫,推出了 claw-code 專案。這個專案在 2 小時內突破 5 萬 GitHub stars,成為 GitHub 史上增長速度最快的倉庫。

專案基本資訊

| 項目 | 數據 |

|---|---|

| 倉庫 | instructkr/claw-code |

| 建立時間 | 2026 年 3 月 31 日 |

| Stars | ~60,205 |

| Forks | ~61,899 |

| 主要語言 | Rust(原為 Python,現正重寫) |

| 授權 | 無(未設定 license) |

作者背景

Sigrid Jin 是韓國開發者,隸屬 InstructKR 組織,擔任 ML 產品與開發者關係工程師。她曾被《華爾街日報》報導,因為去年消耗了 250 億 Claude Code tokens。技術棧橫跨 Python、Golang、TypeScript、Kotlin、Rust。

在洩漏消息傳出後,她使用 oh-my-codex 工具,以 clean-room rewrite 的方式將核心架構用 Python 從零重寫,避免了直接複製原始碼的著作權問題。

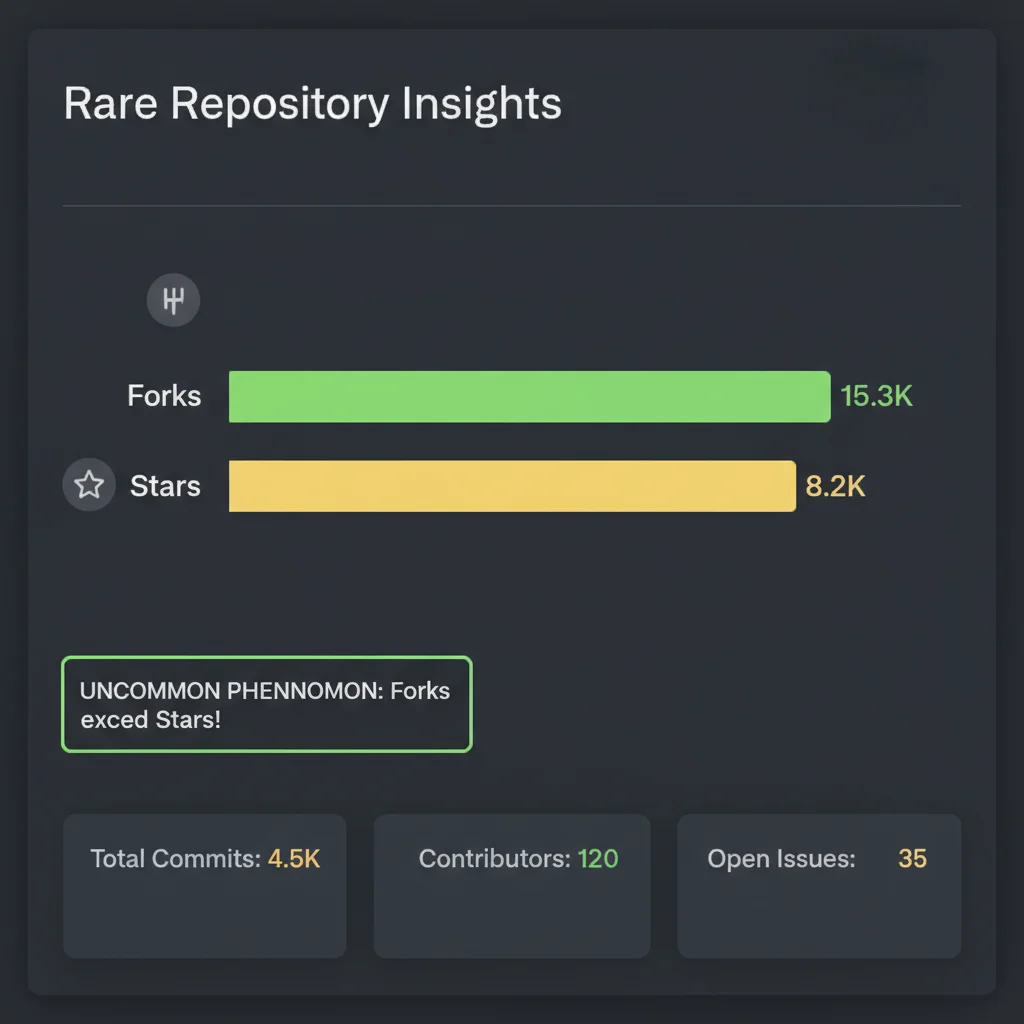

Fork 比 Star 多——我第一次看到這種現象

這是我觀察到的一個非常有趣的數據點:claw-code 的 Fork 數量(~61,899)居然超過了 Star 數量(~60,205)。

在 GitHub 上,這是極為罕見的現象。通常一個熱門專案的 Star/Fork 比例大約是 5:1 到 10:1。也就是說,每 5-10 個按 Star 的人中,只有 1 個會 Fork。

但 claw-code 完全反過來。Fork 比 Star 多,意味著:

- 大量人急著備份:很多人的第一反應不是按 Star,而是 Fork——因為他們擔心這個 repo 隨時會被 DMCA 下架

- 實用價值大於社交價值:Star 是一種社交行為(「我喜歡這個」),Fork 是一種實用行為(「我要用這個」)。Fork > Star 代表人們更關心「拿走程式碼」而非「表達欣賞」

- 時間壓力:在 DMCA 的威脅下,開發者們在搶時間。Fork 是最快的備份方式

這個現象完美詮釋了「搶救式開源」的心態——大家不是在欣賞一個專案,而是在搶救一份可能隨時消失的知識。

對 AI 開發工具產業的五大影響

影響一:npm 安全發布流程的再審視

這起事件再次凸顯了一個老問題:npm 套件發布流程中,source map 檔案的風險管理。

對任何使用 npm 發布工具的團隊來說,這是一個很好的提醒:

- 在 CI/CD pipeline 中加入打包產物的檔案大小和類型檢查

- 明確將

.map檔案加入.npmignore - 發布前自動掃描是否包含敏感檔案

影響二:AI Agent 架構的「教科書」公開了

這是業界首次看到商業級 AI 編碼代理的完整內部架構,包括:

- Prompt 工程的最佳實踐

- 多代理協調機制

- 安全防護的實作方式

- Feature flag 管理策略

對於正在開發 AI Agent 的團隊來說,這份程式碼(不管是原版還是重寫版)都是極具價值的學習材料。

影響三:開源替代品加速發展

claw-code 的出現,加上 Anthropic 先前對 OpenCode 發出的法律威脅,讓「AI 編碼代理需要開源替代品」這個議題變得更加急迫。

如果你的核心開發工具完全依賴一家公司的閉源產品,這起事件應該讓你重新思考風險。

影響四:產品路線圖大曝光

44 個 feature flags 等於是 Anthropic 的產品路線圖。競爭對手現在知道了:

- Anthropic 正在開發自主背景代理(KAIROS)

- 他們有反蒸餾機制來保護模型行為

- 他們正在實作類 DRM 的客戶端認證

這讓 Google、OpenAI、Cursor 等競爭者可以提前應對。

影響五:AI 安全公司的信任危機

Anthropic 最大的賣點之一就是「我們比別人更重視安全」。但在一週內連續出現兩次重大資安事故,這個論述變得很難站得住腳。

不是說 Anthropic 的 AI 安全研究沒有價值——他們在對齊(alignment)和可解釋性(interpretability)領域的研究確實領先。但軟體工程層面的安全和 AI 安全研究是兩回事,這起事件暴露的是前者的問題。

擔心你的 AI 開發工具供應鏈安全?預約免費資安評估,CloudInsight 幫你建立完整的風險防護。

開發者應該如何應對?

如果你在使用 Claude Code

- 更新到最新版本:確保不是使用有問題的 v2.1.88

- 檢查你的 API 金鑰:雖然 Anthropic 聲稱沒有客戶憑證被暴露,但謹慎起見,建議輪換 API 金鑰

- 審視你的依賴鏈:這是一個好機會檢查所有開發工具的安全性

如果你在開發 AI 工具

- 在 CI/CD 中加入敏感檔案掃描:source map、環境變數檔案、內部配置都應該被攔截

- 實作打包產物的 checksum 驗證:確保發布的內容與預期一致

- 分離敏感資訊:feature flags、內部代號、產品路線圖不應該硬編碼在客戶端程式碼中

如果你是技術決策者

- 評估供應商風險:任何閉源工具都有這類風險,建立備選方案

- 考慮混合策略:核心工具鏈中保留至少一個開源選項

- 定期進行安全審計:不只是你的程式碼,也包括你使用的第三方工具

常見問題

Claude Code 原始碼洩漏是駭客攻擊嗎?

不是。這是 Anthropic 在發布 npm 套件時的人為疏失。打包流程中意外包含了 source map 檔案,讓任何人都可以還原完整的 TypeScript 原始碼。沒有外部入侵或內部洩密。

claw-code 和洩漏的原始碼有什麼關係?

claw-code 是韓國開發者 Sigrid Jin 以 clean-room rewrite 方式重寫的專案。她沒有直接複製 Anthropic 的原始碼,而是參考架構後用 Python(後改為 Rust)從零實作。這種方式在法律上不構成著作權侵害,因此無法被 DMCA 下架。

這次洩漏有暴露用戶資料嗎?

根據 Anthropic 的官方聲明,沒有客戶資料或憑證被涉及。洩漏的內容僅限於 Claude Code 工具本身的原始碼和內部配置。

為什麼 claw-code 的 Fork 數量比 Star 多?

這是因為開發者擔心 Anthropic 會發出 DMCA 下架通知,所以優先選擇 Fork(備份程式碼)而非 Star(表達喜好)。這種「搶救式備份」行為導致了 GitHub 上極為罕見的 Fork > Star 現象。

Anthropic 之後採取了什麼行動?

Anthropic 在發現後數小時內移除了問題版本,並對直接鏡像倉庫發出 DMCA 下架通知。他們聲明正在部署防範措施,但截至目前尚未公開具體的改進細節。

結語:安全不是一句口號

這起事件最大的教訓不是「source map 很危險」——這個道理大家都知道。

真正的教訓是:安全是一個系統工程,不是一個品牌定位。你可以投入數億美元做 AI 對齊研究,但如果你的 CI/CD pipeline 連一個 59.8 MB 的異常檔案都攔不住,那你的安全承諾就只是行銷話術。

對我們做雲端和 AI 導入的人來說,這是一個很好的提醒:選擇 AI 工具時,不只看功能和模型能力,也要看這家公司的軟體工程實踐是否夠成熟。

畢竟,一家連自己原始碼都保護不好的公司,你真的放心讓它處理你的商業機密嗎?

想要安全、可靠地導入 AI 開發工具?預約免費 AI 諮詢,CloudInsight 幫你從架構到資安一次搞定。

相關文章

Claude Buddy 是什麼?從原始碼洩漏中意外曝光的 2026 愚人節彩蛋

2026 年 Anthropic 的 Claude Code 原始碼洩漏事件中,開發者意外發現了一個藏在程式碼裡的愚人節電子寵物——Claude Buddy。18 種物種、RPG 數值、1% 閃光機率,這個終端機裡的 Tamagotchi 到底是什麼?

AI 開發工具Gemma 4 完整指南:2026 年最強開源模型從入門到實戰

2026 年 Google 發布 Gemma 4 開源模型,Apache 2.0 授權、四種尺寸(E2B 到 31B)、256K context window、多模態支援。完整解析架構、部署、微調、API 串接與企業導入策略。

AI 開發工具Gemma 4 API 串接教學:Vertex AI 與 Google AI Studio 實戰

2026 年 Gemma 4 API 串接完整教學:Google AI Studio 免費快速上手 vs Vertex AI 企業級部署。含 Python 程式碼範例、多模態輸入、Function Calling、系統提示設定與 API 定價優化策略。